管理集群

- 1: 从 dockershim 迁移

- 2: 用 kubeadm 进行管理

- 2.1: 使用 kubeadm 进行证书管理

- 2.2: 配置 cgroup 驱动

- 2.3: 升级 kubeadm 集群

- 2.4: 添加 Windows 节点

- 2.5: 升级 Windows 节点

- 3: 管理内存,CPU 和 API 资源

- 3.1: 为命名空间配置默认的内存请求和限制

- 3.2: 为命名空间配置默认的 CPU 请求和限制

- 3.3: 配置命名空间的最小和最大内存约束

- 3.4: 为命名空间配置 CPU 最小和最大约束

- 3.5: 为命名空间配置内存和 CPU 配额

- 3.6: 配置命名空间下 Pod 配额

- 4: 证书

- 5: 安装网络规则驱动

- 5.1: 使用 Calico 提供 NetworkPolicy

- 5.2: 使用 Cilium 提供 NetworkPolicy

- 5.3: 使用 kube-router 提供 NetworkPolicy

- 5.4: 使用 Romana 提供 NetworkPolicy

- 5.5: 使用 Weave Net 提供 NetworkPolicy

- 6: IP Masquerade Agent 用户指南

- 7: Kubernetes 云管理控制器

- 8: 为 Kubernetes 运行 etcd 集群

- 9: 为系统守护进程预留计算资源

- 10: 为节点发布扩展资源

- 11: 使用 CoreDNS 进行服务发现

- 12: 使用 KMS 驱动进行数据加密

- 13: 使用 Kubernetes API 访问集群

- 14: 保护集群安全

- 15: 关键插件 Pod 的调度保证

- 16: 升级集群

- 17: 名字空间演练

- 18: 启用/禁用 Kubernetes API

- 19: 启用拓扑感知提示

- 20: 在 Kubernetes 集群中使用 NodeLocal DNSCache

- 21: 在 Kubernetes 集群中使用 sysctl

- 22: 在运行中的集群上重新配置节点的 kubelet

- 23: 声明网络策略

- 24: 安全地清空一个节点

- 25: 将重复的控制平面迁至云控制器管理器

- 26: 开发云控制器管理器

- 27: 开启服务拓扑

- 28: 控制节点上的 CPU 管理策略

- 29: 控制节点上的拓扑管理策略

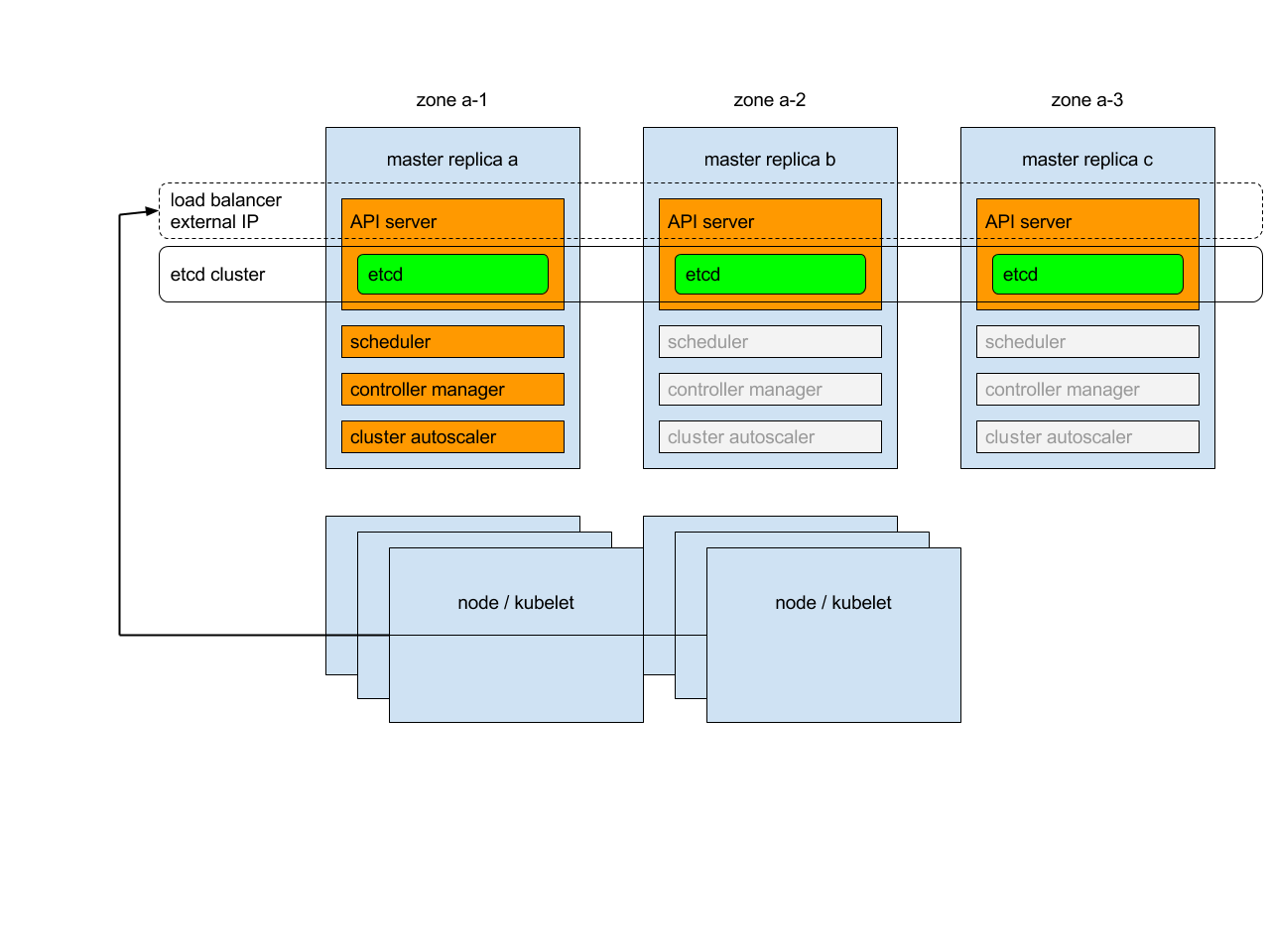

- 30: 搭建高可用的 Kubernetes Masters

- 31: 改变默认 StorageClass

- 32: 更改 PersistentVolume 的回收策略

- 33: 自动扩缩集群 DNS 服务

- 34: 自定义 DNS 服务

- 35: 访问集群上运行的服务

- 36: 调试 DNS 问题

- 37: 通过名字空间共享集群

- 38: 通过配置文件设置 Kubelet 参数

- 39: 配置 API 对象配额

- 40: 配置资源不足时的处理方式

- 41: 限制存储消耗

- 42: 静态加密 Secret 数据

1 - 从 dockershim 迁移

本节提供从 dockershim 迁移到其他容器运行时的必备知识。

自从 Kubernetes 1.20 宣布 弃用 dockershim, 各类疑问随之而来:这对各类工作负载和 Kubernetes 部署会产生什么影响。 你会发现这篇博文对于更好地理解此问题非常有用: 弃用 Dockershim 常见问题

建议从 dockershim 迁移到其他替代的容器运行时。 请参阅容器运行时 一节以了解可用的备选项。 当在迁移过程中遇到麻烦,请上报问题。 那么问题就可以及时修复,你的集群也可以进入移除 dockershim 前的就绪状态。

1.1 - 检查弃用 Dockershim 对你的影响

Kubernetes 的 dockershim 组件使得你可以把 Docker 用作 Kubernetes 的

容器运行时。

在 Kubernetes v1.20 版本中,内建组件 dockershim 被弃用。

本页讲解你的集群把 Docker 用作容器运行时的运作机制,

并提供使用 dockershim 时,它所扮演角色的详细信息,

继而展示了一组验证步骤,可用来检查弃用 dockershim 对你的工作负载的影响。

检查你的应用是否依赖于 Docker

虽然你通过 Docker 创建了应用容器,但这些容器却可以运行于所有容器运行时。 所以这种使用 Docker 容器运行时的方式并不构成对 Docker 的依赖。

当用了替代的容器运行时之后,Docker 命令可能不工作,甚至产生意外的输出。 这才是判定你是否依赖于 Docker 的方法。

- 确认没有特权 Pod 执行 docker 命令。

- 检查 Kubernetes 基础架构外部节点上的脚本和应用,确认它们没有执行 Docker 命令。可能的命令有:

- SSH 到节点排查故障;

- 节点启动脚本;

- 直接安装在节点上的监视和安全代理。

- 检查执行了上述特权操作的第三方工具。详细操作请参考: 从 dockershim 迁移遥测和安全代理

- 确认没有对 dockershim 行为的间接依赖。这是一种极端情况,不太可能影响你的应用。 一些工具很可能被配置为使用了 Docker 特性,比如,基于特定指标发警报,或者在故障排查指令的一个环节中搜索特定的日志信息。 如果你有此类配置的工具,需要在迁移之前,在测试集群上完成功能验证。

Docker 依赖详解

容器运行时是一个软件,用来运行组成 Kubernetes Pod 的容器。 Kubernetes 负责编排和调度 Pod;在每一个节点上, kubelet 使用抽象的容器运行时接口,所以你可以任意选用兼容的容器运行时。

在早期版本中,Kubernetes 提供的兼容性只支持一个容器运行时:Docker。

在 Kubernetes 发展历史中,集群运营人员希望采用更多的容器运行时。

于是 CRI 被设计出来满足这类灵活性需要 - 而 kubelet 亦开始支持 CRI。

然而,因为 Docker 在 CRI 规范创建之前就已经存在,Kubernetes 就创建了一个适配器组件:dockershim。

dockershim 适配器允许 kubelet 与 Docker交互,就好像 Docker 是一个 CRI 兼容的运行时一样。

你可以阅读博文 Kubernetes 容器集成功能的正式发布

切换到容器运行时 Containerd 可以消除掉中间环节。 所有以前遗留的容器可由 Containerd 这类容器运行时来运行和管理,操作体验也和以前一样。 但是现在,由于直接用容器运行时调度容器,所以它们对 Docker 来说是不可见的。 因此,你以前用来检查这些容器的 Docker 工具或漂亮的 UI 都不再可用。

你不能再使用 docker ps 或 docker inspect 命令来获取容器信息。

由于你不能列出容器,因此你不能获取日志、停止容器,甚至不能通过 docker exec 在容器中执行命令。

说明: 如果你用 Kubernetes 运行工作负载,最好通过 Kubernetes API停止容器,而不是通过容器运行时 (此建议适用于所有容器运行时,不仅仅是针对 Docker)。

你仍然可以下载镜像,或者用 docker build 命令创建它们。

但用 Docker 创建、下载的镜像,对于容器运行时和 Kubernetes,均不可见。

为了在 Kubernetes 中使用,需要把镜像推送(push)到某注册中心。

1.2 - 从 dockershim 迁移遥测和安全代理

在 Kubernetes 1.20 版本中,dockershim 被弃用。 在博文弃用 Dockershim 常见问题中, 你大概已经了解到,大多数应用并没有直接通过运行时来托管容器。 但是,仍然有大量的遥测和安全代理依赖 docker 来收集容器元数据、日志和指标。 本文汇总了一些信息和链接:信息用于阐述如何探查这些依赖,链接用于解释如何迁移这些代理去使用通用的工具或其他容器运行。

遥测和安全代理

为了让代理运行在 Kubernetes 集群中,我们有几种办法。 代理既可以直接在节点上运行,也可以作为守护进程运行。

为什么遥测代理依赖于 Docker?

因为历史原因,Kubernetes 建立在 Docker 之上。 Kubernetes 管理网络和调度,Docker 则在具体的节点上定位并操作容器。 所以,你可以从 Kubernetes 取得调度相关的元数据,比如 Pod 名称;从 Docker 取得容器状态信息。 后来,人们开发了更多的运行时来管理容器。 同时一些项目和 Kubernetes 特性也不断涌现,支持跨多个运行时收集容器状态信息。

一些代理和 Docker 工具紧密绑定。此类代理可以这样运行命令,比如用

docker ps

或 docker top

这类命令来列出容器和进程,用

docker logs

订阅 Docker 的日志。

但随着 Docker 作为容器运行时被弃用,这些命令将不再工作。

识别依赖于 Docker 的 DaemonSet

如果某 Pod 想调用运行在节点上的 dockerd,该 Pod 必须满足以下两个条件之一:

- 将包含 Docker 守护进程特权套接字的文件系统挂载为一个卷;或

- 直接以卷的形式挂载 Docker 守护进程特权套接字的特定路径。

举例来说:在 COS 镜像中,Docker 通过 /var/run/docker.sock 开放其 Unix 域套接字。

这意味着 Pod 的规约中需要包含 hostPath 卷以挂载 /var/run/docker.sock。

下面是一个 shell 示例脚本,用于查找包含直接映射 Docker 套接字的挂载点的 Pod。

你也可以删掉 grep /var/run/docker.sock 这一代码片段以查看其它挂载信息。

kubectl get pods --all-namespaces \

-o=jsonpath='{range .items[*]}{"\n"}{.metadata.namespace}{":\t"}{.metadata.name}{":\t"}{range .spec.volumes[*]}{.hostPath.path}{", "}{end}{end}' \

| sort \

| grep '/var/run/docker.sock'

说明: 对于 Pod 来说,访问宿主机上的 Docker 还有其他方式。 例如,可以挂载/var/run的父目录而非其完整路径 (就像这个例子)。 上述脚本只检测最常见的使用方式。

检测节点代理对 Docker 的依赖性

在你的集群节点被定制、且在各个节点上均安装了额外的安全和遥测代理的场景下, 一定要和代理的供应商确认:该代理是否依赖于 Docker。

遥测和安全代理的供应商

我们通过 谷歌文档 提供了为各类遥测和安全代理供应商准备的持续更新的迁移指导。 请与供应商联系,获取从 dockershim 迁移的最新说明。

2 - 用 kubeadm 进行管理

2.1 - 使用 kubeadm 进行证书管理

Kubernetes v1.15 [stable]由 kubeadm 生成的客户端证书在 1 年后到期。 本页说明如何使用 kubeadm 管理证书续订。

准备开始

你应该熟悉 Kubernetes 中的 PKI 证书和要求。

使用自定义的证书

默认情况下, kubeadm 会生成运行一个集群所需的全部证书。 你可以通过提供你自己的证书来改变这个行为策略。

如果要这样做, 你必须将证书文件放置在通过 --cert-dir 命令行参数或者 kubeadm 配置中的

CertificatesDir 配置项指明的目录中。默认的值是 /etc/kubernetes/pki。

如果在运行 kubeadm init 之前存在给定的证书和私钥对,kubeadm 将不会重写它们。

例如,这意味着您可以将现有的 CA 复制到 /etc/kubernetes/pki/ca.crt 和

/etc/kubernetes/pki/ca.key 中,而 kubeadm 将使用此 CA 对其余证书进行签名。

外部 CA 模式

只提供了 ca.crt 文件但是不提供 ca.key 文件也是可以的

(这只对 CA 根证书可用,其它证书不可用)。

如果所有的其它证书和 kubeconfig 文件已就绪,kubeadm 检测到满足以上条件就会激活

"外部 CA" 模式。kubeadm 将会在没有 CA 密钥文件的情况下继续执行。

否则, kubeadm 将独立运行 controller-manager,附加一个

--controllers=csrsigner 的参数,并且指明 CA 证书和密钥。

PKI 证书和要求包括集群使用外部 CA 的设置指南。

检查证书是否过期

你可以使用 check-expiration 子命令来检查证书何时过期

kubeadm certs check-expiration

输出类似于以下内容:

CERTIFICATE EXPIRES RESIDUAL TIME CERTIFICATE AUTHORITY EXTERNALLY MANAGED

admin.conf Dec 30, 2020 23:36 UTC 364d no

apiserver Dec 30, 2020 23:36 UTC 364d ca no

apiserver-etcd-client Dec 30, 2020 23:36 UTC 364d etcd-ca no

apiserver-kubelet-client Dec 30, 2020 23:36 UTC 364d ca no

controller-manager.conf Dec 30, 2020 23:36 UTC 364d no

etcd-healthcheck-client Dec 30, 2020 23:36 UTC 364d etcd-ca no

etcd-peer Dec 30, 2020 23:36 UTC 364d etcd-ca no

etcd-server Dec 30, 2020 23:36 UTC 364d etcd-ca no

front-proxy-client Dec 30, 2020 23:36 UTC 364d front-proxy-ca no

scheduler.conf Dec 30, 2020 23:36 UTC 364d no

CERTIFICATE AUTHORITY EXPIRES RESIDUAL TIME EXTERNALLY MANAGED

ca Dec 28, 2029 23:36 UTC 9y no

etcd-ca Dec 28, 2029 23:36 UTC 9y no

front-proxy-ca Dec 28, 2029 23:36 UTC 9y no

该命令显示 /etc/kubernetes/pki 文件夹中的客户端证书以及

kubeadm(admin.conf, controller-manager.conf 和 scheduler.conf)

使用的 KUBECONFIG 文件中嵌入的客户端证书的到期时间/剩余时间。

另外, kubeadm 会通知用户证书是否由外部管理; 在这种情况下,用户应该小心的手动/使用其他工具来管理证书更新。

警告:kubeadm不能管理由外部 CA 签名的证书

说明: 上面的列表中没有包含kubelet.conf,因为 kubeadm 将 kubelet 配置为 自动更新证书。 轮换的证书位于目录/var/lib/kubelet/pki。 要修复过期的 kubelet 客户端证书,请参阅 kubelet 客户端证书轮换失败。

警告:在通过

kubeadm init创建的节点上,在 kubeadm 1.17 版本之前有一个 缺陷,该缺陷 使得你必须手动修改kubelet.conf文件的内容。kubeadm init操作结束之后,你必须更新kubelet.conf文件 将client-certificate-data和client-key-data改为如下所示的内容 以便使用轮换后的 kubelet 客户端证书:client-certificate: /var/lib/kubelet/pki/kubelet-client-current.pem client-key: /var/lib/kubelet/pki/kubelet-client-current.pem

自动更新证书

kubeadm 会在控制面

升级

的时候更新所有证书。

这个功能旨在解决最简单的用例;如果你对此类证书的更新没有特殊要求, 并且定期执行 Kubernetes 版本升级(每次升级之间的间隔时间少于 1 年), 则 kubeadm 将确保你的集群保持最新状态并保持合理的安全性。

说明: 最佳的做法是经常升级集群以确保安全。

如果你对证书更新有更复杂的需求,则可通过将 --certificate-renewal=false 传递给

kubeadm upgrade apply 或者 kubeadm upgrade node,从而选择不采用默认行为。

警告: kubeadm 在 1.17 版本之前有一个缺陷, 该缺陷导致kubeadm update node执行时--certificate-renewal的默认值被设置为false。 在这种情况下,你需要显式地设置--certificate-renewal=true。

手动更新证书

你能随时通过 kubeadm certs renew 命令手动更新你的证书。

此命令用 CA (或者 front-proxy-CA )证书和存储在 /etc/kubernetes/pki 中的密钥执行更新。

警告: 如果你运行了一个 HA 集群,这个命令需要在所有控制面板节点上执行。

说明:certs renew使用现有的证书作为属性 (Common Name、Organization、SAN 等) 的权威来源, 而不是 kubeadm-config ConfigMap 。强烈建议使它们保持同步。

kubeadm certs renew提供以下选项:

Kubernetes 证书通常在一年后到期。

--csr-only可用于经过一个外部 CA 生成的证书签名请求来更新证书(无需实际替换更新证书); 更多信息请参见下节。- 可以更新单个证书而不是全部证书。

用 Kubernetes 证书 API 更新证书

本节提供有关如何使用 Kubernetes 证书 API 执行手动证书更新的更多详细信息。

注意: 这些是针对需要将其组织的证书基础结构集成到 kubeadm 构建的集群中的用户的高级主题。 如果默认的 kubeadm 配置满足了你的需求,则应让 kubeadm 管理证书。

设置一个签名者(Signer)

Kubernetes 证书颁发机构不是开箱即用。

你可以配置外部签名者,例如

cert-manager,

也可以使用内置签名者。

内置签名者是

kube-controller-manager

的一部分。

要激活内置签名者,请传递 --cluster-signing-cert-file 和 --cluster-signing-key-file 参数。

如果你正在创建一个新的集群,你可以使用 kubeadm 的 配置文件。

apiVersion: kubeadm.k8s.io/v1beta2

kind: ClusterConfiguration

controllerManager:

extraArgs:

cluster-signing-cert-file: /etc/kubernetes/pki/ca.crt

cluster-signing-key-file: /etc/kubernetes/pki/ca.key

创建证书签名请求 (CSR)

有关使用 Kubernetes API 创建 CSR 的信息, 请参见创建 CertificateSigningRequest。

通过外部 CA 更新证书

本节提供有关如何使用外部 CA 执行手动更新证书的更多详细信息。

为了更好的与外部 CA 集成,kubeadm 还可以生成证书签名请求(CSR)。 CSR 表示向 CA 请求客户的签名证书。 在 kubeadm 术语中,通常由磁盘 CA 签名的任何证书都可以作为 CSR 生成。但是,CA 不能作为 CSR 生成。

创建证书签名请求 (CSR)

你可以通过 kubeadm certs renew --csr-only 命令创建证书签名请求。

CSR 和随附的私钥都在输出中给出。

你可以传入一个带有 --csr-dir 的目录,将 CRS 输出到指定位置。

如果未指定 --csr-dir ,则使用默认证书目录(/etc/kubernetes/pki)。

证书可以通过 kubeadm certs renew --csr-only 来续订。

和 kubeadm init 一样,可以使用 --csr-dir 标志指定一个输出目录。

CSR 签署证书后,必须将证书和私钥复制到 PKI 目录(默认情况下为 /etc/kubernetes/pki)。

CSR 中包含一个证书的名字,域和 IP,但是未指定用法。 颁发证书时,CA 有责任指定正确的证书用法

- 在

openssl中,这是通过openssl ca命令 来完成的。 - 在

cfssl中,这是通过 在配置文件中指定用法 来完成的。

使用首选方法对证书签名后,必须将证书和私钥复制到 PKI 目录(默认为 /etc/kubernetes/pki )。

证书机构(CA)轮换

kubeadm 并不直接支持对 CA 证书的轮换或者替换。

关于手动轮换或者置换 CA 的更多信息,可参阅 手动轮换 CA 证书。

启用已签名的 kubelet 服务证书

默认情况下,kubeadm 所部署的 kubelet 服务证书是自签名(Self-Signed))。 这意味着从 metrics-server 这类外部服务发起向 kubelet 的链接时无法使用 TLS 来完成保护。

要在新的 kubeadm 集群中配置 kubelet 以使用被正确签名的服务证书,

你必须向 kubeadm init 传递如下最小配置数据:

apiVersion: kubeadm.k8s.io/v1beta2

kind: ClusterConfiguration

---

apiVersion: kubelet.config.k8s.io/v1beta1

kind: KubeletConfiguration

serverTLSBootstrap: true

如果你已经创建了集群,你必须通过执行下面的操作来完成适配:

- 找到

kube-system名字空间中名为kubelet-config-1.25的 ConfigMap 并编辑之。 在该 ConfigMap 中,kubelet键下面有一个 KubeletConfiguration 文档作为其取值。编辑该 KubeletConfiguration 文档以设置serverTLSBootstrap: true。 - 在每个节点上,在

/var/lib/kubelet/config.yaml文件中添加serverTLSBootstrap: true字段,并使用systemctl restart kubelet来重启 kubelet。

字段 serverTLSBootstrap 将允许启动引导 kubelet 的服务证书,方式

是从 certificates.k8s.io API 处读取。这种方式的一种局限在于这些

证书的 CSR(证书签名请求)不能被 kube-controller-manager 中默认的

签名组件

kubernetes.io/kubelet-serving

批准。需要用户或者第三方控制器来执行此操作。

可以使用下面的命令来查看 CSR:

kubectl get csr

NAME AGE SIGNERNAME REQUESTOR CONDITION

csr-9wvgt 112s kubernetes.io/kubelet-serving system:node:worker-1 Pending

csr-lz97v 1m58s kubernetes.io/kubelet-serving system:node:control-plane-1 Pending

你可以执行下面的操作来批准这些请求:

kubectl certificate approve <CSR-名称>

默认情况下,这些服务证书上会在一年后过期。

kubeadm 将 KubeletConfiguration 的 rotateCertificates 字段设置为

true;这意味着证书快要过期时,会生成一组针对服务证书的新的 CSR,而

这些 CSR 也要被批准才能完成证书轮换。

要进一步了解这里的细节,可参阅

证书轮换

文档。

如果你在寻找一种能够自动批准这些 CSR 的解决方案,建议你与你的云提供商 联系,询问他们是否有 CSR 签名组件,用来以带外(out-of-band)的方式检查 节点的标识符。

注意: 本部分链接到提供 Kubernetes 所需功能的第三方项目。Kubernetes 项目作者不负责这些项目。此页面遵循CNCF 网站指南,按字母顺序列出项目。要将项目添加到此列表中,请在提交更改之前阅读内容指南。

也可以使用第三方定制的控制器:

除非既能够验证 CSR 中的 CommonName,也能检查请求的 IP 和域名, 这类控制器还算不得安全的机制。 只有完成彻底的检查,才有可能避免有恶意的、能够访问 kubelet 客户端证书的第三方 为任何 IP 或域名请求服务证书。

2.2 - 配置 cgroup 驱动

本页阐述如何配置 kubelet 的 cgroup 驱动以匹配 kubeadm 集群中的容器运行时的 cgroup 驱动。

准备开始

你应该熟悉 Kubernetes 的容器运行时需求。

配置容器运行时 cgroup 驱动

容器运行时页面提到:

由于 kubeadm 把 kubelet 视为一个系统服务来管理,所以对基于 kubeadm 的安装,

我们推荐使用 systemd 驱动,不推荐 cgroupfs 驱动。

此页还详述了如何安装若干不同的容器运行时,并将 systemd 设为其默认驱动。

配置 kubelet 的 cgroup 驱动

kubeadm 支持在执行 kubeadm init 时,传递一个 KubeletConfiguration 结构体。

KubeletConfiguration 包含 cgroupDriver 字段,可用于控制 kubelet 的 cgroup 驱动。

Kubernetes v1.21 [stable]说明: 如果用户没有在KubeletConfiguration中设置cgroupDriver字段,kubeadm init会将它设置为默认值systemd。

这是一个最小化的示例,其中显式的配置了此字段:

# kubeadm-config.yaml

kind: ClusterConfiguration

apiVersion: kubeadm.k8s.io/v1beta2

kubernetesVersion: v1.21.0

---

kind: KubeletConfiguration

apiVersion: kubelet.config.k8s.io/v1beta1

cgroupDriver: systemd

这样一个配置文件就可以传递给 kubeadm 命令了:

kubeadm init --config kubeadm-config.yaml

说明:Kubeadm 对集群所有的节点,使用相同的

KubeletConfiguration。KubeletConfiguration存放于kube-system命名空间下的某个 ConfigMap 对象中。执行

init、join和upgrade等子命令会促使 kubeadm 将KubeletConfiguration写入到文件/var/lib/kubelet/config.yaml中, 继而把它传递给本地节点的 kubelet。

使用 cgroupfs 驱动

正如本指南阐述的:不推荐与 kubeadm 一起使用 cgroupfs 驱动。

如仍需使用 cgroupfs,

且要防止 kubeadm upgrade 修改现有系统中 KubeletConfiguration 的 cgroup 驱动,

你必须显式声明它的值。

此方法应对的场景为:在将来某个版本的 kubeadm 中,你不想使用默认的 systemd 驱动。

参阅以下章节“修改 kubelet 的 ConfigMap”,了解显式设置该值的方法。

如果你希望配置容器运行时来使用 cgroupfs 驱动,

则必须参考所选容器运行时的文档。

迁移到 systemd 驱动

要将现有 kubeadm 集群的 cgroup 驱动就地升级为 systemd,

需要执行一个与 kubelet 升级类似的过程。

该过程必须包含下面两个步骤:

说明: 还有一种方法,可以用已配置了systemd的新节点替换掉集群中的老节点。 按这种方法,在加入新节点、确保工作负载可以安全迁移到新节点、及至删除旧节点这一系列操作之前, 只需执行以下第一个步骤。

修改 kubelet 的 ConfigMap

用命令

kubectl get cm -n kube-system | grep kubelet-config找到 kubelet 的 ConfigMap 名称。运行

kubectl edit cm kubelet-config-x.yy -n kube-system(把x.yy替换为 Kubernetes 版本)。修改现有

cgroupDriver的值,或者新增如下式样的字段:cgroupDriver: systemd该字段必须出现在 ConfigMap 的

kubelet:小节下。

更新所有节点的 cgroup 驱动

对于集群中的每一个节点:

- 执行命令

kubectl drain <node-name> --ignore-daemonsets,以 腾空节点 - 执行命令

systemctl stop kubelet,以停止 kubelet - 停止容器运行时

- 修改容器运行时 cgroup 驱动为

systemd - 在文件

/var/lib/kubelet/config.yaml中添加设置cgroupDriver: systemd - 启动容器运行时

- 执行命令

systemctl start kubelet,以启动 kubelet - 执行命令

kubectl uncordon <node-name>,以 取消节点隔离

在节点上依次执行上述步骤,确保工作负载有充足的时间被调度到其他节点。

流程完成后,确认所有节点和工作负载均健康如常。

2.3 - 升级 kubeadm 集群

本页介绍如何将 kubeadm 创建的 Kubernetes 集群从 1.24.x 版本

升级到 1.25.x 版本以及从 1.25.x

升级到 1.25.y(其中 y > x)。略过次版本号的升级是

不被支持的。

要查看 kubeadm 创建的有关旧版本集群升级的信息,请参考以下页面:

- 将 kubeadm 集群从 1.17 升级到 1.18

- 将 kubeadm 集群从 1.16 升级到 1.17

- 将 kubeadm 集群从 1.15 升级到 1.16

- 将 kubeadm 集群从 1.14 升级到 1.15

- 将 kubeadm 集群从 1.13 升级到 1.14

升级工作的基本流程如下:

- 升级主控制平面节点

- 升级其他控制平面节点

- 升级工作节点

准备开始

- 务必仔细认真阅读发行说明。

- 集群应使用静态的控制平面和 etcd Pod 或者外部 etcd。

- 务必备份所有重要组件,例如存储在数据库中应用层面的状态。

kubeadm upgrade不会影响你的工作负载,只会涉及 Kubernetes 内部的组件,但备份终究是好的。 - 必须禁用交换分区。

附加信息

- 在对 kubelet 作次版本升版时需要腾空节点。 对于控制面节点,其上可能运行着 CoreDNS Pods 或者其它非常重要的负载。

- 升级后,因为容器规约的哈希值已更改,所有容器都会被重新启动。

确定要升级到哪个版本

使用操作系统的包管理器找到最新的稳定 1.25:

apt update

apt-cache policy kubeadm

# 在列表中查找最新的 1.25 版本

# 它看起来应该是 1.25.x-00,其中 x 是最新的补丁版本

yum list --showduplicates kubeadm --disableexcludes=kubernetes

# 在列表中查找最新的 1.25 版本

# 它看起来应该是 1.25.x-0,其中 x 是最新的补丁版本

升级控制平面节点

控制面节点上的升级过程应该每次处理一个节点。

首先选择一个要先行升级的控制面节点。该节点上必须拥有

/etc/kubernetes/admin.conf 文件。

执行 "kubeadm upgrade"

升级第一个控制面节点

- 升级 kubeadm:

# 用最新的补丁版本号替换 1.25.x-00 中的 x

apt-mark unhold kubeadm && \

apt-get update && apt-get install -y kubeadm=1.25.x-00 && \

apt-mark hold kubeadm

-

# 从 apt-get 1.1 版本起,你也可以使用下面的方法

apt-get update && \

apt-get install -y --allow-change-held-packages kubeadm=1.25.x-00

# 用最新的补丁版本号替换 1.25.x-0 中的 x

yum install -y kubeadm-1.25.x-0 --disableexcludes=kubernetes

验证下载操作正常,并且 kubeadm 版本正确:

kubeadm version

验证升级计划:

kubeadm upgrade plan此命令检查你的集群是否可被升级,并取回你要升级的目标版本。 命令也会显示一个包含组件配置版本状态的表格。

说明:kubeadm upgrade也会自动对 kubeadm 在节点上所管理的证书执行续约操作。 如果需要略过证书续约操作,可以使用标志--certificate-renewal=false。 更多的信息,可参阅证书管理指南。说明:如果

kubeadm upgrade plan给出任何需要手动升级的组件配置,用户必须 通过--config命令行标志向kubeadm upgrade apply命令提供替代的配置文件。 如果不这样做,kubeadm upgrade apply会出错并退出,不再执行升级操作。

选择要升级到的目标版本,运行合适的命令。例如:

# 将 x 替换为你为此次升级所选择的补丁版本号

sudo kubeadm upgrade apply v1.25.x

一旦该命令结束,你应该会看到:

[upgrade/successful] SUCCESS! Your cluster was upgraded to "v1.25.x". Enjoy!

[upgrade/kubelet] Now that your control plane is upgraded, please proceed with upgrading your kubelets if you haven't already done so.

手动升级你的 CNI 驱动插件。

你的容器网络接口(CNI)驱动应该提供了程序自身的升级说明。 参阅插件页面查找你的 CNI 驱动, 并查看是否需要其他升级步骤。

如果 CNI 驱动作为 DaemonSet 运行,则在其他控制平面节点上不需要此步骤。

对于其它控制面节点

与第一个控制面节点相同,但是使用:

sudo kubeadm upgrade node

而不是:

sudo kubeadm upgrade apply

此外,不需要执行 kubeadm upgrade plan 和更新 CNI 驱动插件的操作。

腾空节点

通过将节点标记为不可调度并腾空节点为节点作升级准备:

# 将 <node-to-drain> 替换为你要腾空的控制面节点名称 kubectl drain <node-to-drain> --ignore-daemonsets

升级 kubelet 和 kubectl

升级 kubelet 和 kubectl

# 用最新的补丁版本替换 1.25.x-00 中的 x apt-mark unhold kubelet kubectl && \ apt-get update && apt-get install -y kubelet=1.25.x-00 kubectl=1.25.x-00 && \ apt-mark hold kubelet kubectl - # 从 apt-get 的 1.1 版本开始,你也可以使用下面的方法: apt-get update && \ apt-get install -y --allow-change-held-packages kubelet=1.25.x-00 kubectl=1.25.x-00

# 用最新的补丁版本号替换 1.25.x-00 中的 x yum install -y kubelet-1.25.x-0 kubectl-1.25.x-0 --disableexcludes=kubernetes

重启 kubelet

sudo systemctl daemon-reload sudo systemctl restart kubelet

解除节点的保护

通过将节点标记为可调度,让其重新上线:

# 将 <node-to-drain> 替换为你的节点名称 kubectl uncordon <node-to-drain>

升级工作节点

工作节点上的升级过程应该一次执行一个节点,或者一次执行几个节点, 以不影响运行工作负载所需的最小容量。

升级 kubeadm

升级 kubeadm:

# 将 1.25.x-00 中的 x 替换为最新的补丁版本号 apt-mark unhold kubeadm && \ apt-get update && apt-get install -y kubeadm=1.25.x-00 && \ apt-mark hold kubeadm - # 从 apt-get 的 1.1 版本开始,你也可以使用下面的方法: apt-get update && \ apt-get install -y --allow-change-held-packages kubeadm=1.25.x-00# 用最新的补丁版本替换 1.25.x-00 中的 x yum install -y kubeadm-1.25.x-0 --disableexcludes=kubernetes

执行 "kubeadm upgrade"

对于工作节点,下面的命令会升级本地的 kubelet 配置:

sudo kubeadm upgrade node

腾空节点

将节点标记为不可调度并驱逐所有负载,准备节点的维护:

# 将 <node-to-drain> 替换为你正在腾空的节点的名称 kubectl drain <node-to-drain> --ignore-daemonsets

升级 kubelet 和 kubectl

升级 kubelet 和 kubectl:

# 将 1.25.x-00 中的 x 替换为最新的补丁版本 apt-mark unhold kubelet kubectl && \ apt-get update && apt-get install -y kubelet=1.25.x-00 kubectl=1.25.x-00 && \ apt-mark hold kubelet kubectl # 从 apt-get 的 1.1 版本开始,你也可以使用下面的方法: apt-get update && \ apt-get install -y --allow-change-held-packages kubelet=1.25.x-00 kubectl=1.25.x-00# 将 1.25.x-0 x 替换为最新的补丁版本 yum install -y kubelet-1.25.x-0 kubectl-1.25.x-0 --disableexcludes=kubernetes

重启 kubelet

sudo systemctl daemon-reload sudo systemctl restart kubelet

取消对节点的保护

通过将节点标记为可调度,让节点重新上线:

# 将 <node-to-drain> 替换为当前节点的名称 kubectl uncordon <node-to-drain>

验证集群的状态

在所有节点上升级 kubelet 后,通过从 kubectl 可以访问集群的任何位置运行以下命令, 验证所有节点是否再次可用:

kubectl get nodes

STATUS 应显示所有节点为 Ready 状态,并且版本号已经被更新。

从故障状态恢复

如果 kubeadm upgrade 失败并且没有回滚,例如由于执行期间节点意外关闭,

你可以再次运行 kubeadm upgrade。

此命令是幂等的,并最终确保实际状态是你声明的期望状态。

要从故障状态恢复,你还可以运行 kubeadm upgrade --force 而无需更改集群正在运行的版本。

在升级期间,kubeadm 向 /etc/kubernetes/tmp 目录下的如下备份文件夹写入数据:

kubeadm-backup-etcd-<date>-<time>kubeadm-backup-manifests-<date>-<time>

kubeadm-backup-etcd 包含当前控制面节点本地 etcd 成员数据的备份。

如果 etcd 升级失败并且自动回滚也无法修复,则可以将此文件夹中的内容复制到

/var/lib/etcd 进行手工修复。如果使用的是外部的 etcd,则此备份文件夹为空。

kubeadm-backup-manifests 包含当前控制面节点的静态 Pod 清单文件的备份版本。

如果升级失败并且无法自动回滚,则此文件夹中的内容可以复制到

/etc/kubernetes/manifests 目录实现手工恢复。

如果由于某些原因,在升级前后某个组件的清单未发生变化,则 kubeadm 也不会为之

生成备份版本。

工作原理

kubeadm upgrade apply 做了以下工作:

- 检查你的集群是否处于可升级状态:

- API 服务器是可访问的

- 所有节点处于

Ready状态 - 控制面是健康的

- 强制执行版本偏差策略。

- 确保控制面的镜像是可用的或可拉取到服务器上。

- 如果组件配置要求版本升级,则生成替代配置与/或使用用户提供的覆盖版本配置。

- 升级控制面组件或回滚(如果其中任何一个组件无法启动)。

- 应用新的

CoreDNS和kube-proxy清单,并强制创建所有必需的 RBAC 规则。 - 如果旧文件在 180 天后过期,将创建 API 服务器的新证书和密钥文件并备份旧文件。

kubeadm upgrade node 在其他控制平节点上执行以下操作:

- 从集群中获取 kubeadm

ClusterConfiguration。 - (可选操作)备份 kube-apiserver 证书。

- 升级控制平面组件的静态 Pod 清单。

- 为本节点升级 kubelet 配置

kubeadm upgrade node 在工作节点上完成以下工作:

- 从集群取回 kubeadm

ClusterConfiguration。 - 为本节点升级 kubelet 配置。

2.4 - 添加 Windows 节点

Kubernetes v1.18 [beta]你可以使用 Kubernetes 来混合运行 Linux 和 Windows 节点,这样你就可以 混合使用运行于 Linux 上的 Pod 和运行于 Windows 上的 Pod。 本页面展示如何将 Windows 节点注册到你的集群。

准备开始

您的 Kubernetes 服务器版本必须不低于版本 1.17. 要获知版本信息,请输入kubectl version.获取 Windows Server 2019 或更高版本的授权 以便配置托管 Windows 容器的 Windows 节点。 如果你在使用 VXLAN/覆盖(Overlay)联网设施,则你还必须安装 KB4489899。

一个利用 kubeadm 创建的基于 Linux 的 Kubernetes 集群;你能访问该集群的控制面 (参见使用 kubeadm 创建一个单控制面的集群)。

教程目标

- 将一个 Windows 节点注册到集群上

- 配置网络,以便 Linux 和 Windows 上的 Pod 和 Service 之间能够相互通信。

开始行动:向你的集群添加一个 Windows 节点

联网配置

一旦你有了一个基于 Linux 的 Kubernetes 控制面节点,你就可以为其选择联网方案。 出于简单考虑,本指南展示如何使用 VXLAN 模式的 Flannel。

配置 Flannel

为 Flannel 准备 Kubernetes 的控制面

在我们的集群中,建议对 Kubernetes 的控制面进行少许准备处理。 建议在使用 Flannel 时为 iptables 链启用桥接方式的 IPv4 流处理, 必须在所有 Linux 节点上执行如下命令:

sudo sysctl net.bridge.bridge-nf-call-iptables=1

下载并配置 Linux 版本的 Flannel

下载最新的 Flannel 清单文件:

wget https://raw.githubusercontent.com/coreos/flannel/master/Documentation/kube-flannel.yml修改 Flannel 清单中的

net-conf.json部分,将 VNI 设置为 4096,并将 Port 设置为 4789。 结果看起来像下面这样:net-conf.json: | { "Network": "10.244.0.0/16", "Backend": { "Type": "vxlan", "VNI": 4096, "Port": 4789 } }说明: 在 Linux 节点上 VNI 必须设置为 4096,端口必须设置为 4789,这样才能令其与 Windows 上的 Flannel 互操作。关于这些字段的详细说明,请参见 VXLAN 文档。说明: 如要使用 L2Bridge/Host-gateway 模式,则可将Type值设置为"host-gw",并忽略VNI和Port的设置。

应用 Flannel 清单并验证

首先应用 Flannel 配置:

kubectl apply -f kube-flannel.yml几分钟之后,如果 Flannel Pod 网络被正确部署,你应该会看到所有 Pods 都处于运行中状态。

kubectl get pods -n kube-system输出中应该包含处于运行中状态的 Linux Flannel DaemonSet:

NAMESPACE NAME READY STATUS RESTARTS AGE ... kube-system kube-flannel-ds-54954 1/1 Running 0 1m

添加 Windows Flannel 和 kube-proxy DaemonSet

现在你可以添加 Windows 兼容版本的 Flannel 和 kube-proxy。为了确保你能获得兼容 版本的 kube-proxy,你需要替换镜像中的标签。 下面的例子中展示的是针对 Kubernetes v1.21.14 版本的用法, 不过你应该根据你自己的集群部署调整其中的版本号。

curl -L https://github.com/kubernetes-sigs/sig-windows-tools/releases/latest/download/kube-proxy.yml | sed 's/VERSION/v1.21.14/g' | kubectl apply -f - kubectl apply -f https://github.com/kubernetes-sigs/sig-windows-tools/releases/latest/download/flannel-overlay.yml说明: 如果你在使用 host-gateway 模式,则应该使用 https://github.com/kubernetes-sigs/sig-windows-tools/releases/latest/download/flannel-host-gw.yml 这一清单。说明:如果你在 Windows 节点上使用的不是以太网(即,"Ethernet0 2")接口,你需要 修改

flannel-host-gw.yml或flannel-overlay.yml文件中的下面这行:wins cli process run --path /k/flannel/setup.exe --args "--mode=overlay --interface=Ethernet"在其中根据情况设置要使用的网络接口。

# Example curl -L https://github.com/kubernetes-sigs/sig-windows-tools/releases/latest/download/flannel-overlay.yml | sed 's/Ethernet/Ethernet0 2/g' | kubectl apply -f -

加入 Windows 工作节点

你必须安装 Containers 功能特性并安装 Docker 工具。相关的指令可以在

Install Docker Engine - Enterprise on Windows Servers

处找到。

Windows 节的所有代码片段都需要在 PowerShell 环境中执行,并且要求在 Windows 工作节点上具有提升的权限(Administrator)。

安装 wins、kubelet 和 kubeadm

curl.exe -LO https://github.com/kubernetes-sigs/sig-windows-tools/releases/latest/download/PrepareNode.ps1 .\PrepareNode.ps1 -KubernetesVersion v1.21.14

运行

kubeadm添加节点当你在控制面主机上运行

kubeadm init时,输出了一个命令。现在运行这个命令。 如果你找不到这个命令,或者命令中对应的令牌已经过期,你可以(在一个控制面主机上)运行kubeadm token create --print-join-command来生成新的令牌和 join 命令。

检查你的安装

你现在应该能够通过运行下面的命令来查看集群中的 Windows 节点了:

kubectl get nodes -o wide

如果你的新节点处于 NotReady 状态,很可能的原因是系统仍在下载 Flannel 镜像。

你可以像之前一样,通过检查 kube-system 名字空间中的 Flannel Pods 来了解

安装进度。

kubectl -n kube-system get pods -l app=flannel

一旦 Flannel Pod 运行起来,你的节点就应该能进入 Ready 状态并可

用来处理负载。

接下来

2.5 - 升级 Windows 节点

Kubernetes v1.18 [beta]本页解释如何升级用 kubeadm 创建的 Windows 节点。

准备开始

你必须拥有一个 Kubernetes 的集群,同时你的 Kubernetes 集群必须带有 kubectl 命令行工具。 如果你还没有集群,你可以通过 Minikube 构建一 个你自己的集群,或者你可以使用下面任意一个 Kubernetes 工具构建:

您的 Kubernetes 服务器版本必须不低于版本 1.17. 要获知版本信息,请输入kubectl version.- 熟悉更新 kubeadm 集群中的其余组件。 在升级你的 Windows 节点之前你会想要升级控制面节点。

升级工作节点

升级 kubeadm

在 Windows 节点上升级 kubeadm:

# 将 v1.21.14 替换为你希望的版本 curl.exe -Lo C:\k\kubeadm.exe https://dl.k8s.io/v1.21.14/bin/windows/amd64/kubeadm.exe

腾空节点

在一个能访问到 Kubernetes API 的机器上,将 Windows 节点标记为不可调度并 驱逐其上的所有负载,以便准备节点维护操作:

# 将 <要腾空的节点> 替换为你要腾空的节点的名称 kubectl drain <要腾空的节点> -ignore-daemonsets你应该会看到类似下面的输出:

node/ip-172-31-85-18 cordoned node/ip-172-31-85-18 drained

升级 kubelet 配置

在 Windows 节点上,执行下面的命令来同步新的 kubelet 配置:

kubeadm upgrade node

升级 kubelet

在 Windows 节点上升级并重启 kubelet:

stop-service kubelet curl.exe -Lo C:\k\kubelet.exe https://dl.k8s.io/v1.21.14/bin/windows/amd64/kubelet.exe restart-service kubelet

对节点执行 uncordon 操作

从一台能够访问到 Kubernetes API 的机器上,通过将节点标记为可调度,使之 重新上线:

# 将 <要腾空的节点> 替换为你的节点名称 kubectl uncordon <要腾空的节点>

升级 kube-proxy

在一台可访问 Kubernetes API 的机器上和,将 v1.21.14 替换成你 期望的版本后再次执行下面的命令:

curl -L https://github.com/kubernetes-sigs/sig-windows-tools/releases/latest/download/kube-proxy.yml | sed 's/VERSION/v1.21.14/g' | kubectl apply -f -

3 - 管理内存,CPU 和 API 资源

3.1 - 为命名空间配置默认的内存请求和限制

本文介绍怎样给命名空间配置默认的内存请求和限制。 如果在一个有默认内存限制的命名空间创建容器,该容器没有声明自己的内存限制时, 将会被指定默认内存限制。 Kubernetes 还为某些情况指定了默认的内存请求,本章后面会进行介绍。

准备开始

你必须拥有一个 Kubernetes 的集群,同时你的 Kubernetes 集群必须带有 kubectl 命令行工具。 如果你还没有集群,你可以通过 Minikube 构建一 个你自己的集群,或者你可以使用下面任意一个 Kubernetes 工具构建:

要获知版本信息,请输入kubectl version.你的集群中的每个节点必须至少有 2 GiB 的内存。

创建命名空间

创建一个命名空间,以便本练习中所建的资源与集群的其余资源相隔离。

kubectl create namespace default-mem-example

创建 LimitRange 和 Pod

这里给出了一个限制范围对象的配置文件。该配置声明了一个默认的内存请求和一个默认的内存限制。

apiVersion: v1

kind: LimitRange

metadata:

name: mem-limit-range

spec:

limits:

- default:

memory: 512Mi

defaultRequest:

memory: 256Mi

type: Container

在 default-mem-example 命名空间创建限制范围:

kubectl apply -f https://k8s.io/examples/admin/resource/memory-defaults.yaml --namespace=default-mem-example

现在,如果在 default-mem-example 命名空间创建容器,并且该容器没有声明自己的内存请求和限制值, 它将被指定默认的内存请求 256 MiB 和默认的内存限制 512 MiB。

下面是具有一个容器的 Pod 的配置文件。 容器未指定内存请求和限制。

apiVersion: v1

kind: Pod

metadata:

name: default-mem-demo

spec:

containers:

- name: default-mem-demo-ctr

image: nginx

创建 Pod

kubectl apply -f https://k8s.io/examples/admin/resource/memory-defaults-pod.yaml --namespace=default-mem-example

查看 Pod 的详情:

kubectl get pod default-mem-demo --output=yaml --namespace=default-mem-example

输出内容显示该 Pod 的容器有 256 MiB 的内存请求和 512 MiB 的内存限制。 这些都是 LimitRange 设置的默认值。

containers:

- image: nginx

imagePullPolicy: Always

name: default-mem-demo-ctr

resources:

limits:

memory: 512Mi

requests:

memory: 256Mi

删除你的 Pod:

kubectl delete pod default-mem-demo --namespace=default-mem-example

声明容器的限制而不声明它的请求会怎么样?

这里给出了包含一个容器的 Pod 的配置文件。该容器声明了内存限制,而没有声明内存请求:

apiVersion: v1

kind: Pod

metadata:

name: default-mem-demo-2

spec:

containers:

- name: default-mem-demo-2-ctr

image: nginx

resources:

limits:

memory: "1Gi"

创建 Pod:

kubectl apply -f https://k8s.io/examples/admin/resource/memory-defaults-pod-2.yaml --namespace=default-mem-example

查看 Pod 的详情:

kubectl get pod default-mem-demo-2 --output=yaml --namespace=default-mem-example

输出结果显示容器的内存请求被设置为它的内存限制相同的值。注意该容器没有被指定默认的内存请求值 256MiB。

resources:

limits:

memory: 1Gi

requests:

memory: 1Gi

声明容器的内存请求而不声明内存限制会怎么样?

这里给出了一个包含一个容器的 Pod 的配置文件。该容器声明了内存请求,但没有内存限制:

apiVersion: v1

kind: Pod

metadata:

name: default-mem-demo-3

spec:

containers:

- name: default-mem-demo-3-ctr

image: nginx

resources:

requests:

memory: "128Mi"

创建 Pod:

kubectl apply -f https://k8s.io/examples/admin/resource/memory-defaults-pod-3.yaml --namespace=default-mem-example

查看 Pod 声明:

kubectl get pod default-mem-demo-3 --output=yaml --namespace=default-mem-example

输出结果显示该容器的内存请求被设置为了容器配置文件中声明的数值。 容器的内存限制被设置为 512MiB,即命名空间的默认内存限制。

resources:

limits:

memory: 512Mi

requests:

memory: 128Mi

设置默认内存限制和请求的动机

如果你的命名空间有资源配额,那么默认内存限制是很有帮助的。 下面是一个例子,通过资源配额为命名空间设置两项约束:

- 运行在命名空间中的每个容器必须有自己的内存限制。

- 命名空间中所有容器的内存使用量之和不能超过声明的限制值。

如果一个容器没有声明自己的内存限制,会被指定默认限制,然后它才会被允许在限定了配额的命名空间中运行。

清理

删除你的命名空间:

kubectl delete namespace default-mem-example

接下来

集群管理员参考

应用开发者参考

3.2 - 为命名空间配置默认的 CPU 请求和限制

本章介绍怎样为命名空间配置默认的 CPU 请求和限制。 一个 Kubernetes 集群可被划分为多个命名空间。如果在配置了 CPU 限制的命名空间创建容器, 并且该容器没有声明自己的 CPU 限制,那么这个容器会被指定默认的 CPU 限制。 Kubernetes 在一些特定情况还会指定 CPU 请求,本文后续章节将会对其进行解释。

准备开始

你必须拥有一个 Kubernetes 的集群,同时你的 Kubernetes 集群必须带有 kubectl 命令行工具。 如果你还没有集群,你可以通过 Minikube 构建一 个你自己的集群,或者你可以使用下面任意一个 Kubernetes 工具构建:

要获知版本信息,请输入kubectl version.创建命名空间

创建一个命名空间,以便本练习中创建的资源和集群的其余部分相隔离。

kubectl create namespace default-cpu-example

创建 LimitRange 和 Pod

这里给出了 LimitRange 对象的配置文件。该配置声明了一个默认的 CPU 请求和一个默认的 CPU 限制。

apiVersion: v1

kind: LimitRange

metadata:

name: cpu-limit-range

spec:

limits:

- default:

cpu: 1

defaultRequest:

cpu: 0.5

type: Container

在命名空间 default-cpu-example 中创建 LimitRange 对象:

kubectl apply -f https://k8s.io/examples/admin/resource/cpu-defaults.yaml --namespace=default-cpu-example

现在如果在 default-cpu-example 命名空间创建一个容器,该容器没有声明自己的 CPU 请求和限制时, 将会给它指定默认的 CPU 请求0.5和默认的 CPU 限制值1.

这里给出了包含一个容器的 Pod 的配置文件。该容器没有声明 CPU 请求和限制。

apiVersion: v1

kind: Pod

metadata:

name: default-cpu-demo

spec:

containers:

- name: default-cpu-demo-ctr

image: nginx

创建 Pod。

kubectl apply -f https://k8s.io/examples/admin/resource/cpu-defaults-pod.yaml --namespace=default-cpu-example

查看该 Pod 的声明:

kubectl get pod default-cpu-demo --output=yaml --namespace=default-cpu-example

输出显示该 Pod 的容器有一个500 millicpus的 CPU 请求和一个1 cpu的 CPU 限制。这些是 LimitRange 声明的默认值。

containers:

- image: nginx

imagePullPolicy: Always

name: default-cpu-demo-ctr

resources:

limits:

cpu: "1"

requests:

cpu: 500m

你只声明容器的限制,而不声明请求会怎么样?

这是包含一个容器的 Pod 的配置文件。该容器声明了 CPU 限制,而没有声明 CPU 请求。

apiVersion: v1

kind: Pod

metadata:

name: default-cpu-demo-2

spec:

containers:

- name: default-cpu-demo-2-ctr

image: nginx

resources:

limits:

cpu: "1"

创建 Pod

kubectl apply -f https://k8s.io/examples/admin/resource/cpu-defaults-pod-2.yaml --namespace=default-cpu-example

查看 Pod 的声明:

kubectl get pod default-cpu-demo-2 --output=yaml --namespace=default-cpu-example

输出显示该容器的 CPU 请求和 CPU 限制设置相同。注意该容器没有被指定默认的 CPU 请求值0.5 cpu。

resources:

limits:

cpu: "1"

requests:

cpu: "1"

你只声明容器的请求,而不声明它的限制会怎么样?

这里给出了包含一个容器的 Pod 的配置文件。该容器声明了 CPU 请求,而没有声明 CPU 限制。

apiVersion: v1

kind: Pod

metadata:

name: default-cpu-demo-3

spec:

containers:

- name: default-cpu-demo-3-ctr

image: nginx

resources:

requests:

cpu: "0.75"

创建 Pod:

kubectl apply -f https://k8s.io/examples/admin/resource/cpu-defaults-pod-3.yaml --namespace=default-cpu-example

查看 Pod 的规约:

kubectl get pod default-cpu-demo-3 --output=yaml --namespace=default-cpu-example

结果显示该容器的 CPU 请求被设置为容器配置文件中声明的数值。 容器的CPU限制被设置为 1 CPU,即该命名空间的默认 CPU 限制值。

resources:

limits:

cpu: "1"

requests:

cpu: 750m

默认 CPU 限制和请求的动机

如果你的命名空间有一个 资源配额, 那么有一个默认的 CPU 限制是有帮助的。这里有资源配额强加给命名空间的两条限制:

- 命名空间中运行的每个容器必须有自己的 CPU 限制。

- 命名空间中所有容器使用的 CPU 总和不能超过一个声明值。

如果容器没有声明自己的 CPU 限制,将会给它一个默认限制,这样它就能被允许运行在一个有配额限制的命名空间中。

清理

删除你的命名空间:

kubectl delete namespace constraints-cpu-example

接下来

集群管理员参考

- 为命名空间配置默认内存请求和限制

- 为命名空间配置内存限制的最小值和最大值

- 为命名空间配置 CPU 限制的最小值和最大值

- 为命名空间配置内存和 CPU 配额

- 为命名空间配置 Pod 配额

- 为 API 对象配置配额

应用开发者参考

3.3 - 配置命名空间的最小和最大内存约束

本页介绍如何设置在命名空间中运行的容器使用的内存的最小值和最大值。 你可以在 LimitRange 对象中指定最小和最大内存值。如果 Pod 不满足 LimitRange 施加的约束,则无法在命名空间中创建它。

准备开始

你必须拥有一个 Kubernetes 的集群,同时你的 Kubernetes 集群必须带有 kubectl 命令行工具。 如果你还没有集群,你可以通过 Minikube 构建一 个你自己的集群,或者你可以使用下面任意一个 Kubernetes 工具构建:

要获知版本信息,请输入kubectl version.集群中每个节点必须至少要有 1 GiB 的内存。

创建命名空间

创建一个命名空间,以便在此练习中创建的资源与群集的其余资源隔离。

kubectl create namespace constraints-mem-example

创建 LimitRange 和 Pod

下面是 LimitRange 的配置文件:

apiVersion: v1

kind: LimitRange

metadata:

name: mem-min-max-demo-lr

spec:

limits:

- max:

memory: 1Gi

min:

memory: 500Mi

type: Container

创建 LimitRange:

kubectl apply -f https://k8s.io/examples/admin/resource/memory-constraints.yaml --namespace=constraints-mem-example

查看 LimitRange 的详情:

kubectl get limitrange mem-min-max-demo-lr --namespace=constraints-mem-example --output=yaml

输出显示预期的最小和最大内存约束。 但请注意,即使你没有在 LimitRange 的配置文件中指定默认值,也会自动创建它们。

limits:

- default:

memory: 1Gi

defaultRequest:

memory: 1Gi

max:

memory: 1Gi

min:

memory: 500Mi

type: Container

现在,只要在 constraints-mem-example 命名空间中创建容器,Kubernetes 就会执行下面的步骤:

如果 Container 未指定自己的内存请求和限制,将为它指定默认的内存请求和限制。

验证 Container 的内存请求是否大于或等于500 MiB。

验证 Container 的内存限制是否小于或等于1 GiB。

这里给出了包含一个 Container 的 Pod 配置文件。Container 声明了 600 MiB 的内存请求和 800 MiB 的内存限制, 这些满足了 LimitRange 施加的最小和最大内存约束。

apiVersion: v1

kind: Pod

metadata:

name: constraints-mem-demo

spec:

containers:

- name: constraints-mem-demo-ctr

image: nginx

resources:

limits:

memory: "800Mi"

requests:

memory: "600Mi"

创建 Pod:

kubectl apply -f https://k8s.io/examples/admin/resource/memory-constraints-pod.yaml --namespace=constraints-mem-example

确认下 Pod 中的容器在运行:

kubectl get pod constraints-mem-demo --namespace=constraints-mem-example

查看 Pod 详情:

kubectl get pod constraints-mem-demo --output=yaml --namespace=constraints-mem-example

输出结果显示容器的内存请求为600 MiB,内存限制为800 MiB。这些满足了 LimitRange 设定的限制范围。

resources:

limits:

memory: 800Mi

requests:

memory: 600Mi

删除你创建的 Pod:

kubectl delete pod constraints-mem-demo --namespace=constraints-mem-example

尝试创建一个超过最大内存限制的 Pod

这里给出了包含一个容器的 Pod 的配置文件。容器声明了800 MiB 的内存请求和1.5 GiB 的内存限制。

apiVersion: v1

kind: Pod

metadata:

name: constraints-mem-demo-2

spec:

containers:

- name: constraints-mem-demo-2-ctr

image: nginx

resources:

limits:

memory: "1.5Gi"

requests:

memory: "800Mi"

尝试创建 Pod:

kubectl apply -f https://k8s.io/examples/admin/resource/memory-constraints-pod-2.yaml --namespace=constraints-mem-example

输出结果显示 Pod 没有创建成功,因为容器声明的内存限制太大了:

Error from server (Forbidden): error when creating "examples/admin/resource/memory-constraints-pod-2.yaml":

pods "constraints-mem-demo-2" is forbidden: maximum memory usage per Container is 1Gi, but limit is 1536Mi.

尝试创建一个不满足最小内存请求的 Pod

这里给出了包含一个容器的 Pod 的配置文件。容器声明了100 MiB 的内存请求和800 MiB 的内存限制。

apiVersion: v1

kind: Pod

metadata:

name: constraints-mem-demo-3

spec:

containers:

- name: constraints-mem-demo-3-ctr

image: nginx

resources:

limits:

memory: "800Mi"

requests:

memory: "100Mi"

尝试创建 Pod:

kubectl apply -f https://k8s.io/examples/admin/resource/memory-constraints-pod-3.yaml --namespace=constraints-mem-example

输出结果显示 Pod 没有创建成功,因为容器声明的内存请求太小了:

Error from server (Forbidden): error when creating "examples/admin/resource/memory-constraints-pod-3.yaml":

pods "constraints-mem-demo-3" is forbidden: minimum memory usage per Container is 500Mi, but request is 100Mi.

创建一个没有声明内存请求和限制的 Pod

这里给出了包含一个容器的 Pod 的配置文件。容器没有声明内存请求,也没有声明内存限制。

apiVersion: v1

kind: Pod

metadata:

name: constraints-mem-demo-4

spec:

containers:

- name: constraints-mem-demo-4-ctr

image: nginx

创建 Pod:

kubectl apply -f https://k8s.io/examples/admin/resource/memory-constraints-pod-4.yaml --namespace=constraints-mem-example

查看 Pod 详情:

kubectl get pod constraints-mem-demo-4 --namespace=constraints-mem-example --output=yaml

输出结果显示 Pod 的内存请求为1 GiB,内存限制为1 GiB。容器怎样获得哪些数值呢?

resources:

limits:

memory: 1Gi

requests:

memory: 1Gi

因为你的容器没有声明自己的内存请求和限制,它从 LimitRange 那里获得了 默认的内存请求和限制。

此时,你的容器可能运行起来也可能没有运行起来。 回想一下我们本次任务的先决条件是你的每个节点都至少有1 GiB 的内存。 如果你的每个节点都只有1 GiB 的内存,那将没有一个节点拥有足够的可分配内存来满足1 GiB 的内存请求。

删除你的 Pod:

kubectl delete pod constraints-mem-demo-4 --namespace=constraints-mem-example

强制执行内存最小和最大限制

LimitRange 为命名空间设定的最小和最大内存限制只有在 Pod 创建和更新时才会强制执行。 如果你更新 LimitRange,它不会影响此前创建的 Pod。

设置内存最小和最大限制的动因

作为集群管理员,你可能想规定 Pod 可以使用的内存总量限制。例如:

- 集群的每个节点有 2 GB 内存。你不想接受任何请求超过 2 GB 的 Pod,因为集群中没有节点可以满足。

- 集群由生产部门和开发部门共享。你希望允许产品部门的负载最多耗用 8 GB 内存, 但是开发部门的负载最多可使用 512 MiB。 这时,你可以为产品部门和开发部门分别创建名字空间,并为各个名字空间设置内存约束。

清理

删除你的命名空间:

kubectl delete namespace constraints-mem-example

接下来

集群管理员参考

- 为命名空间配置默认内存请求和限制

- 为命名空间配置内存限制的最小值和最大值

- 为命名空间配置 CPU 限制的最小值和最大值

- 为命名空间配置内存和 CPU 配额

- 为命名空间配置 Pod 配额

- 为 API 对象配置配额

应用开发者参考

3.4 - 为命名空间配置 CPU 最小和最大约束

本页介绍如何为命名空间中容器和 Pod 使用的 CPU 资源设置最小和最大值。 你可以通过 LimitRange 对象声明 CPU 的最小和最大值. 如果 Pod 不能满足 LimitRange 的限制,它就不能在命名空间中创建。

准备开始

你必须拥有一个 Kubernetes 的集群,同时你的 Kubernetes 集群必须带有 kubectl 命令行工具。 如果你还没有集群,你可以通过 Minikube 构建一 个你自己的集群,或者你可以使用下面任意一个 Kubernetes 工具构建:

要获知版本信息,请输入kubectl version.你的集群中每个节点至少要有 1 个 CPU 可用才能运行本任务示例。

创建命名空间

创建一个命名空间,以便本练习中创建的资源和集群的其余资源相隔离。

kubectl create namespace constraints-cpu-example

创建 LimitRange 和 Pod

这里给出了 LimitRange 的配置文件:

apiVersion: v1

kind: LimitRange

metadata:

name: cpu-min-max-demo-lr

spec:

limits:

- max:

cpu: "800m"

min:

cpu: "200m"

type: Container

创建 LimitRange:

kubectl apply -f https://k8s.io/examples/admin/resource/cpu-constraints.yaml --namespace=constraints-cpu-example

查看 LimitRange 详情:

kubectl get limitrange cpu-min-max-demo-lr --output=yaml --namespace=constraints-cpu-example

输出结果显示 CPU 的最小和最大限制符合预期。但需要注意的是,尽管你在 LimitRange 的配置文件中你没有声明默认值,默认值也会被自动创建。

limits:

- default:

cpu: 800m

defaultRequest:

cpu: 800m

max:

cpu: 800m

min:

cpu: 200m

type: Container

现在不管什么时候在 constraints-cpu-example 命名空间中创建容器,Kubernetes 都会执行下面这些步骤:

如果容器没有声明自己的 CPU 请求和限制,将为容器指定默认 CPU 请求和限制。

核查容器声明的 CPU 请求确保其大于或者等于 200 millicpu。

核查容器声明的 CPU 限制确保其小于或者等于 800 millicpu。

说明: 当创建 LimitRange 对象时,你也可以声明大页面和 GPU 的限制。 当这些资源同时声明了 'default' 和 'defaultRequest' 参数时,两个参数值必须相同。

这里给出了包含一个容器的 Pod 的配置文件。 该容器声明了 500 millicpu 的 CPU 请求和 800 millicpu 的 CPU 限制。 这些参数满足了 LimitRange 对象规定的 CPU 最小和最大限制。

apiVersion: v1

kind: Pod

metadata:

name: constraints-cpu-demo

spec:

containers:

- name: constraints-cpu-demo-ctr

image: nginx

resources:

limits:

cpu: "800m"

requests:

cpu: "500m"

创建Pod:

kubectl apply -f https://k8s.io/examples/admin/resource/cpu-constraints-pod.yaml --namespace=constraints-cpu-example

确认一下 Pod 中的容器在运行:

kubectl get pod constraints-cpu-demo --namespace=constraints-cpu-example

查看 Pod 的详情:

kubectl get pod constraints-cpu-demo --output=yaml --namespace=constraints-cpu-example

输出结果表明容器的 CPU 请求为 500 millicpu,CPU 限制为 800 millicpu。 这些参数满足 LimitRange 规定的限制范围。

resources:

limits:

cpu: 800m

requests:

cpu: 500m

删除 Pod

kubectl delete pod constraints-cpu-demo --namespace=constraints-cpu-example

尝试创建一个超过最大 CPU 限制的 Pod

这里给出了包含一个容器的 Pod 的配置文件。容器声明了 500 millicpu 的 CPU 请求和 1.5 CPU 的 CPU 限制。

apiVersion: v1

kind: Pod

metadata:

name: constraints-cpu-demo-2

spec:

containers:

- name: constraints-cpu-demo-2-ctr

image: nginx

resources:

limits:

cpu: "1.5"

requests:

cpu: "500m"

尝试创建 Pod:

kubectl apply -f https://k8s.io/examples/admin/resource/cpu-constraints-pod-2.yaml --namespace=constraints-cpu-example

输出结果表明 Pod 没有创建成功,因为容器声明的 CPU 限制太大了:

Error from server (Forbidden): error when creating "examples/admin/resource/cpu-constraints-pod-2.yaml":

pods "constraints-cpu-demo-2" is forbidden: maximum cpu usage per Container is 800m, but limit is 1500m.

尝试创建一个不满足最小 CPU 请求的 Pod

这里给出了包含一个容器的 Pod 的配置文件。该容器声明了100 millicpu的 CPU 请求和800 millicpu的 CPU 限制。

apiVersion: v1

kind: Pod

metadata:

name: constraints-cpu-demo-3

spec:

containers:

- name: constraints-cpu-demo-3-ctr

image: nginx

resources:

limits:

cpu: "800m"

requests:

cpu: "100m"

尝试创建 Pod:

kubectl apply -f https://k8s.io/examples/admin/resource/cpu-constraints-pod-3.yaml --namespace=constraints-cpu-example

输出结果显示 Pod 没有创建成功,因为容器声明的 CPU 请求太小了:

Error from server (Forbidden): error when creating "examples/admin/resource/cpu-constraints-pod-3.yaml":

pods "constraints-cpu-demo-4" is forbidden: minimum cpu usage per Container is 200m, but request is 100m.

创建一个没有声明 CPU 请求和 CPU 限制的 Pod

这里给出了包含一个容器的 Pod 的配置文件。该容器没有设定 CPU 请求和 CPU 限制。

apiVersion: v1

kind: Pod

metadata:

name: constraints-cpu-demo-4

spec:

containers:

- name: constraints-cpu-demo-4-ctr

image: vish/stress

创建 Pod:

kubectl apply -f https://k8s.io/examples/admin/resource/cpu-constraints-pod-4.yaml --namespace=constraints-cpu-example

查看 Pod 的详情:

kubectl get pod constraints-cpu-demo-4 --namespace=constraints-cpu-example --output=yaml

输出结果显示 Pod 的容器有个 800 millicpu 的 CPU 请求和 800 millicpu 的 CPU 限制。 容器是怎样得到那些值的呢?

resources:

limits:

cpu: 800m

requests:

cpu: 800m

因为你的 Container 没有声明自己的 CPU 请求和限制,LimitRange 给它指定了 默认的 CPU 请求和限制

此时,你的容器可能运行也可能没有运行。 回想一下,本任务的先决条件是你的节点要有 1 个 CPU。 如果你的每个节点仅有 1 个 CPU,那么可能没有任何一个节点可以满足 800 millicpu 的 CPU 请求。 如果你在用的节点恰好有两个 CPU,那么你才可能有足够的 CPU 来满足 800 millicpu 的请求。

kubectl delete pod constraints-cpu-demo-4 --namespace=constraints-cpu-example

CPU 最小和最大限制的强制执行

只有当 Pod 创建或者更新时,LimitRange 为命名空间规定的 CPU 最小和最大限制才会被强制执行。 如果你对 LimitRange 进行修改,那不会影响此前创建的 Pod。

最小和最大 CPU 限制范围的动机

作为集群管理员,你可能想设定 Pod 可以使用的 CPU 资源限制。例如:

- 集群中的每个节点有两个 CPU。你不想接受任何请求超过 2 个 CPU 的 Pod,因为集群中没有节点可以支持这种请求。

- 你的生产和开发部门共享一个集群。你想允许生产工作负载消耗 3 个 CPU, 而开发部门工作负载的消耗限制为 1 个 CPU。 你可以为生产和开发创建不同的命名空间,并且为每个命名空间都应用 CPU 限制。

清理

删除你的命名空间:

kubectl delete namespace constraints-cpu-example

接下来

集群管理员参考:

- 为命名空间配置默认内存请求和限制

- 为命名空间配置内存限制的最小值和最大值

- 为命名空间配置 CPU 限制的最小值和最大值

- 为命名空间配置内存和 CPU 配额

- 为命名空间配置 Pod 配额

- 为 API 对象配置配额

应用开发者参考:

3.5 - 为命名空间配置内存和 CPU 配额

本文介绍怎样为命名空间设置容器可用的内存和 CPU 总量。你可以通过 ResourceQuota 对象设置配额.

准备开始

你必须拥有一个 Kubernetes 的集群,同时你的 Kubernetes 集群必须带有 kubectl 命令行工具。 如果你还没有集群,你可以通过 Minikube 构建一 个你自己的集群,或者你可以使用下面任意一个 Kubernetes 工具构建:

要获知版本信息,请输入kubectl version.集群中每个节点至少有 1 GiB 的内存。

创建命名空间

创建一个命名空间,以便本练习中创建的资源和集群的其余部分相隔离。

kubectl create namespace quota-mem-cpu-example

创建 ResourceQuota

这里给出一个 ResourceQuota 对象的配置文件:

apiVersion: v1

kind: ResourceQuota

metadata:

name: mem-cpu-demo

spec:

hard:

requests.cpu: "1"

requests.memory: 1Gi

limits.cpu: "2"

limits.memory: 2Gi

创建 ResourceQuota

kubectl apply -f https://k8s.io/examples/admin/resource/quota-mem-cpu.yaml --namespace=quota-mem-cpu-example

查看 ResourceQuota 详情:

kubectl get resourcequota mem-cpu-demo --namespace=quota-mem-cpu-example --output=yaml

ResourceQuota 在 quota-mem-cpu-example 命名空间中设置了如下要求:

- 每个容器必须有内存请求和限制,以及 CPU 请求和限制。

- 所有容器的内存请求总和不能超过1 GiB。

- 所有容器的内存限制总和不能超过2 GiB。

- 所有容器的 CPU 请求总和不能超过1 cpu。

- 所有容器的 CPU 限制总和不能超过2 cpu。

创建 Pod

这里给出 Pod 的配置文件:

apiVersion: v1

kind: Pod

metadata:

name: quota-mem-cpu-demo

spec:

containers:

- name: quota-mem-cpu-demo-ctr

image: nginx

resources:

limits:

memory: "800Mi"

cpu: "800m"

requests:

memory: "600Mi"

cpu: "400m"

创建 Pod:

kubectl apply -f https://k8s.io/examples/admin/resource/quota-mem-cpu-pod.yaml --namespace=quota-mem-cpu-example

检查下 Pod 中的容器在运行:

kubectl get pod quota-mem-cpu-demo --namespace=quota-mem-cpu-example

再查看 ResourceQuota 的详情:

kubectl get resourcequota mem-cpu-demo --namespace=quota-mem-cpu-example --output=yaml

输出结果显示了配额以及有多少配额已经被使用。你可以看到 Pod 的内存和 CPU 请求值及限制值没有超过配额。

status:

hard:

limits.cpu: "2"

limits.memory: 2Gi

requests.cpu: "1"

requests.memory: 1Gi

used:

limits.cpu: 800m

limits.memory: 800Mi

requests.cpu: 400m

requests.memory: 600Mi

尝试创建第二个 Pod

这里给出了第二个 Pod 的配置文件:

apiVersion: v1

kind: Pod

metadata:

name: quota-mem-cpu-demo-2

spec:

containers:

- name: quota-mem-cpu-demo-2-ctr

image: redis

resources:

limits:

memory: "1Gi"

cpu: "800m"

requests:

memory: "700Mi"

cpu: "400m"

配置文件中,你可以看到 Pod 的内存请求为 700 MiB。 请注意新的内存请求与已经使用的内存请求只和超过了内存请求的配额。 600 MiB + 700 MiB > 1 GiB。

尝试创建 Pod:

kubectl apply -f https://k8s.io/examples/admin/resource/quota-mem-cpu-pod-2.yaml --namespace=quota-mem-cpu-example

第二个 Pod 不能被创建成功。输出结果显示创建第二个 Pod 会导致内存请求总量超过内存请求配额。

Error from server (Forbidden): error when creating "examples/admin/resource/quota-mem-cpu-pod-2.yaml":

pods "quota-mem-cpu-demo-2" is forbidden: exceeded quota: mem-cpu-demo,

requested: requests.memory=700Mi,used: requests.memory=600Mi, limited: requests.memory=1Gi

讨论

如你在本练习中所见,你可以用 ResourceQuota 限制命名空间中所有容器的内存请求总量。 同样你也可以限制内存限制总量、CPU 请求总量、CPU 限制总量。

如果你想对单个容器而不是所有容器进行限制,就请使用 LimitRange。

清理

删除你的命名空间:

kubectl delete namespace quota-mem-cpu-example

接下来

集群管理员参考

- 为命名空间配置默认内存请求和限制

- 为命名空间配置内存限制的最小值和最大值

- 为命名空间配置 CPU 限制的最小值和最大值

- 为命名空间配置内存和 CPU 配额

- 为命名空间配置 Pod 配额

- 为 API 对象配置配额

应用开发者参考

3.6 - 配置命名空间下 Pod 配额

本文主要描述如何配置一个命名空间下可运行的 Pod 个数配额。 你可以使用 ResourceQuota 对象来配置配额。

准备开始

你必须拥有一个 Kubernetes 的集群,同时你的 Kubernetes 集群必须带有 kubectl 命令行工具。 如果你还没有集群,你可以通过 Minikube 构建一 个你自己的集群,或者你可以使用下面任意一个 Kubernetes 工具构建:

要获知版本信息,请输入kubectl version.创建一个命名空间

首先创建一个命名空间,这样可以将本次操作中创建的资源与集群其他资源隔离开来。

kubectl create namespace quota-pod-example

创建 ResourceQuota

下面是一个 ResourceQuota 的配置文件:

apiVersion: v1

kind: ResourceQuota

metadata:

name: pod-demo

spec:

hard:

pods: "2"

创建这个 ResourceQuota:

kubectl apply -f https://k8s.io/examples/admin/resource/quota-pod.yaml --namespace=quota-pod-example

查看资源配额的详细信息:

kubectl get resourcequota pod-demo --namespace=quota-pod-example --output=yaml

从输出的信息我们可以看到,该命名空间下 Pod 的配额是 2 个,目前创建的 Pod 数为 0, 配额使用率为 0。

spec:

hard:

pods: "2"

status:

hard:

pods: "2"

used:

pods: "0"

下面是一个 Deployment 的配置文件:

apiVersion: apps/v1

kind: Deployment

metadata:

name: pod-quota-demo

spec:

selector:

matchLabels:

purpose: quota-demo

replicas: 3

template:

metadata:

labels:

purpose: quota-demo

spec:

containers:

- name: pod-quota-demo

image: nginx

在配置文件中,replicas: 3 告诉 Kubernetes 尝试创建三个 Pods,且运行相同的应用。

创建这个 Deployment:

kubectl apply -f https://k8s.io/examples/admin/resource/quota-pod-deployment.yaml --namespace=quota-pod-example

查看 Deployment 的详细信息:

kubectl get deployment pod-quota-demo --namespace=quota-pod-example --output=yaml

从输出的信息我们可以看到,尽管尝试创建三个 Pod,但是由于配额的限制,只有两个 Pod 能被成功创建。

spec:

...

replicas: 3

...

status:

availableReplicas: 2

...

lastUpdateTime: 2017-07-07T20:57:05Z

message: 'unable to create pods: pods "pod-quota-demo-1650323038-" is forbidden:

exceeded quota: pod-demo, requested: pods=1, used: pods=2, limited: pods=2'

清理

删除命名空间:

kubectl delete namespace quota-pod-example

接下来

集群管理人员参考

- 为命名空间配置默认的内存请求和限制

- 为命名空间配置默认的的 CPU 请求和限制

- 为命名空间配置内存的最小值和最大值约束

- 为命名空间配置 CPU 的最小值和最大值约束

- 为命名空间配置内存和 CPU 配额

- 为 API 对象的设置配额

应用开发人员参考

4 - 证书

在使用客户端证书认证的场景下,你可以通过 easyrsa、openssl 或 cfssl 等工具以手工方式生成证书。

easyrsa

easyrsa 支持以手工方式为你的集群生成证书。

下载、解压、初始化打过补丁的 easyrsa3。

curl -LO https://storage.googleapis.com/kubernetes-release/easy-rsa/easy-rsa.tar.gz tar xzf easy-rsa.tar.gz cd easy-rsa-master/easyrsa3 ./easyrsa init-pki生成新的证书颁发机构(CA)。参数

--batch用于设置自动模式; 参数--req-cn用于设置新的根证书的通用名称(CN)。./easyrsa --batch "--req-cn=${MASTER_IP}@`date +%s`" build-ca nopass生成服务器证书和秘钥。 参数

--subject-alt-name设置 API 服务器的 IP 和 DNS 名称。MASTER_CLUSTER_IP用于 API 服务器和控制管理器,通常取 CIDR 的第一个 IP,由--service-cluster-ip-range的参数提供。 参数--days用于设置证书的过期时间。 下面的示例假定你的默认 DNS 域名为cluster.local。./easyrsa --subject-alt-name="IP:${MASTER_IP},"\ "IP:${MASTER_CLUSTER_IP},"\ "DNS:kubernetes,"\ "DNS:kubernetes.default,"\ "DNS:kubernetes.default.svc,"\ "DNS:kubernetes.default.svc.cluster,"\ "DNS:kubernetes.default.svc.cluster.local" \ --days=10000 \ build-server-full server nopass拷贝文件

pki/ca.crt、pki/issued/server.crt和pki/private/server.key到你的目录中。在 API 服务器的启动参数中添加以下参数:

--client-ca-file=/yourdirectory/ca.crt --tls-cert-file=/yourdirectory/server.crt --tls-private-key-file=/yourdirectory/server.key

openssl

openssl 支持以手工方式为你的集群生成证书。

生成一个 2048 位的 ca.key 文件

openssl genrsa -out ca.key 2048在 ca.key 文件的基础上,生成 ca.crt 文件(用参数 -days 设置证书有效期)

openssl req -x509 -new -nodes -key ca.key -subj "/CN=${MASTER_IP}" -days 10000 -out ca.crt生成一个 2048 位的 server.key 文件:

openssl genrsa -out server.key 2048创建一个用于生成证书签名请求(CSR)的配置文件。 保存文件(例如:

csr.conf)前,记得用真实值替换掉尖括号中的值(例如:<MASTER_IP>)。 注意:MASTER_CLUSTER_IP就像前一小节所述,它的值是 API 服务器的服务集群 IP。 下面的例子假定你的默认 DNS 域名为cluster.local。[ req ] default_bits = 2048 prompt = no default_md = sha256 req_extensions = req_ext distinguished_name = dn [ dn ] C = <country> ST = <state> L = <city> O = <organization> OU = <organization unit> CN = <MASTER_IP> [ req_ext ] subjectAltName = @alt_names [ alt_names ] DNS.1 = kubernetes DNS.2 = kubernetes.default DNS.3 = kubernetes.default.svc DNS.4 = kubernetes.default.svc.cluster DNS.5 = kubernetes.default.svc.cluster.local IP.1 = <MASTER_IP> IP.2 = <MASTER_CLUSTER_IP> [ v3_ext ] authorityKeyIdentifier=keyid,issuer:always basicConstraints=CA:FALSE keyUsage=keyEncipherment,dataEncipherment extendedKeyUsage=serverAuth,clientAuth subjectAltName=@alt_names基于上面的配置文件生成证书签名请求:

openssl req -new -key server.key -out server.csr -config csr.conf基于 ca.key、ca.key 和 server.csr 等三个文件生成服务端证书:

openssl x509 -req -in server.csr -CA ca.crt -CAkey ca.key \ -CAcreateserial -out server.crt -days 10000 \ -extensions v3_ext -extfile csr.conf查看证书:

openssl x509 -noout -text -in ./server.crt

最后,为 API 服务器添加相同的启动参数。

cfssl

cfssl 是另一个用于生成证书的工具。

下载、解压并准备如下所示的命令行工具。 注意:你可能需要根据所用的硬件体系架构和 cfssl 版本调整示例命令。

curl -L https://github.com/cloudflare/cfssl/releases/download/v1.5.0/cfssl_1.5.0_linux_amd64 -o cfssl chmod +x cfssl curl -L https://github.com/cloudflare/cfssl/releases/download/v1.5.0/cfssljson_1.5.0_linux_amd64 -o cfssljson chmod +x cfssljson curl -L https://github.com/cloudflare/cfssl/releases/download/v1.5.0/cfssl-certinfo_1.5.0_linux_amd64 -o cfssl-certinfo chmod +x cfssl-certinfo创建一个目录,用它保存所生成的构件和初始化 cfssl:

mkdir cert cd cert ../cfssl print-defaults config > config.json ../cfssl print-defaults csr > csr.json创建一个 JSON 配置文件来生成 CA 文件,例如:

ca-config.json:{ "signing": { "default": { "expiry": "8760h" }, "profiles": { "kubernetes": { "usages": [ "signing", "key encipherment", "server auth", "client auth" ], "expiry": "8760h" } } } }创建一个 JSON 配置文件,用于 CA 证书签名请求(CSR),例如:

ca-csr.json。 确认用你需要的值替换掉尖括号中的值。{ "CN": "kubernetes", "key": { "algo": "rsa", "size": 2048 }, "names":[{ "C": "<country>", "ST": "<state>", "L": "<city>", "O": "<organization>", "OU": "<organization unit>" }] }生成 CA 秘钥文件(

ca-key.pem)和证书文件(ca.pem):../cfssl gencert -initca ca-csr.json | ../cfssljson -bare ca创建一个 JSON 配置文件,用来为 API 服务器生成秘钥和证书,例如:

server-csr.json。 确认用你需要的值替换掉尖括号中的值。MASTER_CLUSTER_IP是为 API 服务器 指定的服务集群 IP,就像前面小节描述的那样。 以下示例假定你的默认 DSN 域名为cluster.local。{ "CN": "kubernetes", "hosts": [ "127.0.0.1", "<MASTER_IP>", "<MASTER_CLUSTER_IP>", "kubernetes", "kubernetes.default", "kubernetes.default.svc", "kubernetes.default.svc.cluster", "kubernetes.default.svc.cluster.local" ], "key": { "algo": "rsa", "size": 2048 }, "names": [{ "C": "<country>", "ST": "<state>", "L": "<city>", "O": "<organization>", "OU": "<organization unit>" }] }为 API 服务器生成秘钥和证书,默认会分别存储为

server-key.pem和server.pem两个文件。../cfssl gencert -ca=ca.pem -ca-key=ca-key.pem \ --config=ca-config.json -profile=kubernetes \ server-csr.json | ../cfssljson -bare server

分发自签名的 CA 证书

客户端节点可能不认可自签名 CA 证书的有效性。 对于非生产环境,或者运行在公司防火墙后的环境,你可以分发自签名的 CA 证书到所有客户节点,并刷新本地列表以使证书生效。

在每一个客户节点,执行以下操作:

sudo cp ca.crt /usr/local/share/ca-certificates/kubernetes.crt

sudo update-ca-certificates

Updating certificates in /etc/ssl/certs...

1 added, 0 removed; done.

Running hooks in /etc/ca-certificates/update.d....

done.

证书 API

你可以通过 certificates.k8s.io API 提供 x509 证书,用来做身份验证,

如本文档所述。

5 - 安装网络规则驱动

5.1 - 使用 Calico 提供 NetworkPolicy

本页展示了几种在 Kubernetes 上快速创建 Calico 集群的方法。

准备开始

在 Google Kubernetes Engine (GKE) 上创建一个 Calico 集群

先决条件: gcloud

启动一个带有 Calico 的 GKE 集群,只需加上参数

--enable-network-policy。语法

gcloud container clusters create [CLUSTER_NAME] --enable-network-policy示例

gcloud container clusters create my-calico-cluster --enable-network-policy

使用如下命令验证部署是否正确。

kubectl get pods --namespace=kube-systemCalico 的 pods 名以

calico打头,检查确认每个 pods 状态为Running。

使用 kubeadm 创建一个本地 Calico 集群

使用 kubeadm 在 15 分钟内得到一个本地单主机 Calico 集群,请参考 Calico 快速入门。

接下来

集群运行后,您可以按照声明网络策略 去尝试使用 Kubernetes NetworkPolicy。

5.2 - 使用 Cilium 提供 NetworkPolicy

本页展示如何使用 Cilium 提供 NetworkPolicy。

关于 Cilium 的背景知识,请阅读 Cilium 介绍。

准备开始

你必须拥有一个 Kubernetes 的集群,同时你的 Kubernetes 集群必须带有 kubectl 命令行工具。 如果你还没有集群,你可以通过 Minikube 构建一 个你自己的集群,或者你可以使用下面任意一个 Kubernetes 工具构建:

要获知版本信息,请输入kubectl version.在 Minikube 上部署 Cilium 用于基本测试

为了轻松熟悉 Cilium 你可以根据 Cilium Kubernetes 入门指南 在 minikube 中执行一个 cilium 的基本 DaemonSet 安装。

要启动 minikube,需要的最低版本为 1.3.1,使用下面的参数运行:

minikube version

minikube version: v1.3.1

minikube start --network-plugin=cni --memory=4096

挂载 BPF 文件系统:

minikube ssh -- sudo mount bpffs -t bpf /sys/fs/bpf

在 minikube 环境中,你可以部署下面的"一体化" YAML 文件,其中包含 Cilium 的 DaemonSet 配置以及适当的 RBAC 配置:

kubectl create -f https://raw.githubusercontent.com/cilium/cilium/v1.8/install/kubernetes/quick-install.yaml

configmap/cilium-config created

serviceaccount/cilium created

serviceaccount/cilium-operator created

clusterrole.rbac.authorization.k8s.io/cilium created

clusterrole.rbac.authorization.k8s.io/cilium-operator created

clusterrolebinding.rbac.authorization.k8s.io/cilium created

clusterrolebinding.rbac.authorization.k8s.io/cilium-operator created

daemonset.apps/cilium create

deployment.apps/cilium-operator created

入门指南其余的部分用一个示例应用说明了如何强制执行 L3/L4(即 IP 地址+端口)的安全策略 以及L7 (如 HTTP)的安全策略。

部署 Cilium 用于生产用途

关于部署 Cilium 用于生产的详细说明,请见 Cilium Kubernetes 安装指南 此文档包括详细的需求、说明和生产用途 DaemonSet 文件示例。

了解 Cilium 组件

部署使用 Cilium 的集群会添加 Pods 到 kube-system 命名空间。要查看 Pod 列表,运行:

kubectl get pods --namespace=kube-system

你将看到像这样的 Pods 列表:

NAME READY STATUS RESTARTS AGE

cilium-6rxbd 1/1 Running 0 1m

...

你的集群中的每个节点上都会运行一个 cilium Pod,通过使用 Linux BPF

针对该节点上的 Pod 的入站、出站流量实施网络策略控制。

接下来

集群运行后,你可以按照 声明网络策略 试用基于 Cilium 的 Kubernetes NetworkPolicy。 玩得开心,如果你有任何疑问,请到 Cilium Slack 频道 联系我们。

5.3 - 使用 kube-router 提供 NetworkPolicy

本页展示如何使用 Kube-router 提供 NetworkPolicy。

准备开始

你需要拥有一个运行中的 Kubernetes 集群。如果你还没有集群,可以使用任意的集群 安装程序如 Kops、Bootkube、Kubeadm 等创建一个。

安装 kube-router 插件

kube-router 插件自带一个网络策略控制器,监视来自于 Kubernetes API 服务器的 NetworkPolicy 和 Pod 的变化,根据策略指示配置 iptables 规则和 ipsets 来允许或阻止流量。 请根据 通过集群安装程序尝试 kube-router 指南安装 kube-router 插件。

接下来

在你安装了 kube-router 插件后,可以参考 声明网络策略 去尝试使用 Kubernetes NetworkPolicy。

5.4 - 使用 Romana 提供 NetworkPolicy

本页展示如何使用 Romana 作为 NetworkPolicy。

准备开始

完成 kubeadm 入门指南中的 1、2、3 步。

使用 kubeadm 安装 Romana

按照容器化安装指南, 使用 kubeadm 安装。

应用网络策略

使用以下的一种方式应用网络策略:

- Romana 网络策略

- NetworkPolicy API

接下来

Romana 安装完成后,你可以按照 声明网络策略 去尝试使用 Kubernetes NetworkPolicy。

5.5 - 使用 Weave Net 提供 NetworkPolicy

本页展示如何使用使用 Weave Net 提供 NetworkPolicy。

准备开始

你需要拥有一个 Kubernetes 集群。按照 kubeadm 入门指南 来启动一个。

安装 Weave Net 插件

按照通过插件集成 Kubernetes 指南执行安装。

Kubernetes 的 Weave Net 插件带有

网络策略控制器,

可自动监控 Kubernetes 所有名字空间的 NetworkPolicy 注释,

配置 iptables 规则以允许或阻止策略指示的流量。

测试安装

验证 weave 是否有效。

输入以下命令:

kubectl get po -n kube-system -o wide

输出类似这样:

NAME READY STATUS RESTARTS AGE IP NODE

weave-net-1t1qg 2/2 Running 0 9d 192.168.2.10 worknode3

weave-net-231d7 2/2 Running 1 7d 10.2.0.17 worknodegpu

weave-net-7nmwt 2/2 Running 3 9d 192.168.2.131 masternode

weave-net-pmw8w 2/2 Running 0 9d 192.168.2.216 worknode2

每个 Node 都有一个 weave Pod,所有 Pod 都是Running 和 2/2 READY。

(2/2 表示每个 Pod 都有 weave 和 weave-npc)

接下来

安装 Weave Net 插件后,你可以参考 声明网络策略 来试用 Kubernetes NetworkPolicy。 如果你有任何疑问,请通过 Slack 上的 #weave-community 频道或者 Weave 用户组 联系我们。

6 - IP Masquerade Agent 用户指南

此页面展示如何配置和启用 ip-masq-agent。

准备开始

你必须拥有一个 Kubernetes 的集群,同时你的 Kubernetes 集群必须带有 kubectl 命令行工具。 如果你还没有集群,你可以通过 Minikube 构建一 个你自己的集群,或者你可以使用下面任意一个 Kubernetes 工具构建:

要获知版本信息,请输入kubectl version.IP Masquerade Agent 用户指南

ip-masq-agent 配置 iptables 规则以隐藏位于集群节点 IP 地址后面的 Pod 的 IP 地址。 这通常在将流量发送到集群的 Pod CIDR 范围之外的目的地时使用。

关键术语

- NAT (网络地址转译) 是一种通过修改 IP 地址头中的源和/或目标地址信息将一个 IP 地址重新映射 到另一个 IP 地址的方法。通常由执行 IP 路由的设备执行。

- 伪装 NAT 的一种形式,通常用于执行多对一地址转换,其中多个源 IP 地址被隐藏在 单个地址后面,该地址通常是执行 IP 路由的设备。在 Kubernetes 中, 这是节点的 IP 地址。

- CIDR (无类别域间路由) 基于可变长度子网掩码,允许指定任意长度的前缀。 CIDR 引入了一种新的 IP 地址表示方法,现在通常称为CIDR表示法, 其中地址或路由前缀后添加一个后缀,用来表示前缀的位数,例如 192.168.2.0/24。

- 本地链路 本地链路是仅对网段或主机所连接的广播域内的通信有效的网络地址。 IPv4 的本地链路地址在 CIDR 表示法的地址块 169.254.0.0/16 中定义。

ip-masq-agent 配置 iptables 规则,以便在将流量发送到集群节点的 IP 和集群 IP 范围之外的目标时 处理伪装节点或 Pod 的 IP 地址。这本质上隐藏了集群节点 IP 地址后面的 Pod IP 地址。 在某些环境中,去往“外部”地址的流量必须从已知的机器地址发出。 例如,在 Google Cloud 中,任何到互联网的流量都必须来自 VM 的 IP。 使用容器时,如 Google Kubernetes Engine,从 Pod IP 发出的流量将被拒绝出站。 为了避免这种情况,我们必须将 Pod IP 隐藏在 VM 自己的 IP 地址后面 - 通常称为“伪装”。 默认情况下,代理配置为将 RFC 1918 指定的三个私有 IP 范围视为非伪装 CIDR。 这些范围是 10.0.0.0/8,172.16.0.0/12 和 192.168.0.0/16。 默认情况下,代理还将链路本地地址(169.254.0.0/16)视为非伪装 CIDR。 代理程序配置为每隔 60 秒从 /etc/config/ip-masq-agent 重新加载其配置, 这也是可修改的。

代理配置文件必须使用 YAML 或 JSON 语法编写,并且可能包含三个可选值:

- nonMasqueradeCIDRs: CIDR 表示法中的字符串列表,用于指定不需伪装的地址范围。

- masqLinkLocal: 布尔值 (true / false),表示是否将流量伪装到 本地链路前缀 169.254.0.0/16。默认为 false。

- resyncInterval: 代理尝试从磁盘重新加载配置的时间间隔。 例如 '30s',其中 's' 是秒,'ms' 是毫秒等...

10.0.0.0/8、172.16.0.0/12 和 192.168.0.0/16 范围内的流量不会被伪装。 任何其他流量(假设是互联网)将被伪装。 Pod 访问本地目的地的例子,可以是其节点的 IP 地址、另一节点的地址或集群的 IP 地址范围内的一个 IP 地址。 默认情况下,任何其他流量都将伪装。以下条目展示了 ip-masq-agent 的默认使用的规则:

iptables -t nat -L IP-MASQ-AGENT

RETURN all -- anywhere 169.254.0.0/16 /* ip-masq-agent: cluster-local traffic should not be subject to MASQUERADE */ ADDRTYPE match dst-type !LOCAL

RETURN all -- anywhere 10.0.0.0/8 /* ip-masq-agent: cluster-local traffic should not be subject to MASQUERADE */ ADDRTYPE match dst-type !LOCAL

RETURN all -- anywhere 172.16.0.0/12 /* ip-masq-agent: cluster-local traffic should not be subject to MASQUERADE */ ADDRTYPE match dst-type !LOCAL

RETURN all -- anywhere 192.168.0.0/16 /* ip-masq-agent: cluster-local traffic should not be subject to MASQUERADE */ ADDRTYPE match dst-type !LOCAL

MASQUERADE all -- anywhere anywhere /* ip-masq-agent: outbound traffic should be subject to MASQUERADE (this match must come after cluster-local CIDR matches) */ ADDRTYPE match dst-type !LOCAL

默认情况下,从 Kubernetes 1.7.0 版本开始的 GCE/Google Kubernetes Engine 中, 如果启用了网络策略,或者你使用的集群 CIDR 不在 10.0.0.0/8 范围内, 则 ip-masq-agent 将在你的集群中运行。 如果你在其他环境中运行,则可以将 ip-masq-agent DaemonSet 添加到你的集群:

创建 ip-masq-agent

通过运行以下 kubectl 指令创建 ip-masq-agent:

kubectl apply -f https://raw.githubusercontent.com/kubernetes-sigs/ip-masq-agent/master/ip-masq-agent.yaml

你必须同时将适当的节点标签应用于集群中希望代理运行的任何节点。

kubectl label nodes my-node beta.kubernetes.io/masq-agent-ds-ready=true

更多信息可以通过 ip-masq-agent 文档 这里 找到。

在大多数情况下,默认的规则集应该足够;但是,如果你的群集不是这种情况,则可以创建并应用 ConfigMap 来自定义受影响的 IP 范围。 例如,要允许 ip-masq-agent 仅作用于 10.0.0.0/8,你可以在一个名为 “config” 的文件中创建以下 ConfigMap 。

说明:重要的是,该文件之所以被称为 config,因为默认情况下,该文件将被用作 ip-masq-agent 查找的主键:

nonMasqueradeCIDRs: - 10.0.0.0/8 resyncInterval: 60s

运行以下命令将配置映射添加到你的集群:

kubectl create configmap ip-masq-agent --from-file=config --namespace=kube-system

这将更新位于 /etc/config/ip-masq-agent 的一个文件,该文件以 resyncInterval 为周期定期检查并应用于集群节点。 重新同步间隔到期后,你应该看到你的更改在 iptables 规则中体现:

iptables -t nat -L IP-MASQ-AGENT

Chain IP-MASQ-AGENT (1 references)

target prot opt source destination

RETURN all -- anywhere 169.254.0.0/16 /* ip-masq-agent: cluster-local traffic should not be subject to MASQUERADE */ ADDRTYPE match dst-type !LOCAL

RETURN all -- anywhere 10.0.0.0/8 /* ip-masq-agent: cluster-local

MASQUERADE all -- anywhere anywhere /* ip-masq-agent: outbound traffic should be subject to MASQUERADE (this match must come after cluster-local CIDR matches) */ ADDRTYPE match dst-type !LOCAL

默认情况下,本地链路范围 (169.254.0.0/16) 也由 ip-masq agent 处理, 该代理设置适当的 iptables 规则。 要使 ip-masq-agent 忽略本地链路, 可以在配置映射中将 masqLinkLocal 设置为 true。

nonMasqueradeCIDRs:

- 10.0.0.0/8

resyncInterval: 60s

masqLinkLocal: true

7 - Kubernetes 云管理控制器

Kubernetes v1.11 [beta]由于云驱动的开发和发布的步调与 Kubernetes 项目不同,将服务提供商专用代码抽象到

cloud-controller-manager

二进制中有助于云服务厂商在 Kubernetes 核心代码之外独立进行开发。

cloud-controller-manager 可以被链接到任何满足

cloudprovider.Interface

约束的云服务提供商。为了兼容旧版本,Kubernetes 核心项目中提供的

cloud-controller-manager

使用和 kube-controller-manager 相同的云服务类库。

已经在 Kubernetes 核心项目中支持的云服务提供商预计将通过使用 in-tree 的 cloud-controller-manager

过渡为非 Kubernetes 核心代码。

管理

需求

每个云服务都有一套各自的需求用于系统平台的集成,这不应与运行

kube-controller-manager 的需求有太大差异。作为经验法则,你需要:

- 云服务认证/授权:你的云服务可能需要使用令牌或者 IAM 规则以允许对其 API 的访问

- kubernetes 认证/授权:cloud-controller-manager 可能需要 RBAC 规则以访问 kubernetes apiserver

- 高可用:类似于 kube-controller-manager,你可能希望通过主节点选举(默认开启)配置一个高可用的云管理控制器。

运行云管理控制器

你需要对集群配置做适当的修改以成功地运行云管理控制器:

- 一定不要为

kube-apiserver和kube-controller-manager指定--cloud-provider标志。 这将保证它们不会运行任何云服务专用循环逻辑,这将会由云管理控制器运行。未来这个标记将被废弃并去除。 kubelet必须使用--cloud-provider=external运行。 这是为了保证让 kubelet 知道在执行任何任务前,它必须被云管理控制器初始化。

请记住,设置群集使用云管理控制器将用多种方式更改群集行为:

- 指定了

--cloud-provider=external的 kubelet 将被添加一个node.cloudprovider.kubernetes.io/uninitialized的污点,导致其在初始化过程中不可调度(NoSchedule)。 这将标记该节点在能够正常调度前,需要外部的控制器进行二次初始化。 请注意,如果云管理控制器不可用,集群中的新节点会一直处于不可调度的状态。 这个污点很重要,因为调度器可能需要关于节点的云服务特定的信息,比如他们的区域或类型 (高端 CPU、GPU 支持、内存较大、临时实例等)。

- 集群中节点的云服务信息将不再能够从本地元数据中获取,取而代之的是所有获取节点信息的 API 调用都将通过云管理控制器。这意味着你可以通过限制到 kubelet 云服务 API 的访问来提升安全性。 在更大的集群中你可能需要考虑云管理控制器是否会遇到速率限制, 因为它现在负责集群中几乎所有到云服务的 API 调用。

云管理控制器可以实现:

- 节点控制器 - 负责使用云服务 API 更新 kubernetes 节点并删除在云服务上已经删除的 kubernetes 节点。

- 服务控制器 - 负责在云服务上为类型为 LoadBalancer 的 service 提供负载均衡器。

- 路由控制器 - 负责在云服务上配置网络路由。

- 如果你使用的是 out-of-tree 提供商,请按需实现其余任意特性。

示例

如果当前 Kubernetes 内核支持你使用的云服务,并且想要采用云管理控制器,请参见 kubernetes 内核中的云管理控制器。

对于不在 Kubernetes 核心代码库中的云管理控制器,你可以在云服务厂商或 SIG 领导者的源中找到对应的项目。

对于已经存在于 Kubernetes 内核中的提供商,你可以在集群中将 in-tree 云管理控制器作为守护进程运行。请使用如下指南:

# This is an example of how to setup cloud-controller-manager as a Daemonset in your cluster.

# It assumes that your masters can run pods and has the role node-role.kubernetes.io/master

# Note that this Daemonset will not work straight out of the box for your cloud, this is

# meant to be a guideline.

---

apiVersion: v1

kind: ServiceAccount

metadata:

name: cloud-controller-manager

namespace: kube-system

---

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRoleBinding

metadata:

name: system:cloud-controller-manager

roleRef:

apiGroup: rbac.authorization.k8s.io

kind: ClusterRole

name: cluster-admin

subjects:

- kind: ServiceAccount

name: cloud-controller-manager

namespace: kube-system

---

apiVersion: apps/v1

kind: DaemonSet

metadata:

labels:

k8s-app: cloud-controller-manager

name: cloud-controller-manager

namespace: kube-system

spec:

selector:

matchLabels:

k8s-app: cloud-controller-manager

template:

metadata:

labels:

k8s-app: cloud-controller-manager

spec:

serviceAccountName: cloud-controller-manager

containers:

- name: cloud-controller-manager

# for in-tree providers we use k8s.gcr.io/cloud-controller-manager

# this can be replaced with any other image for out-of-tree providers

image: k8s.gcr.io/cloud-controller-manager:v1.8.0

command:

- /usr/local/bin/cloud-controller-manager

- --cloud-provider=[YOUR_CLOUD_PROVIDER] # Add your own cloud provider here!

- --leader-elect=true

- --use-service-account-credentials

# these flags will vary for every cloud provider

- --allocate-node-cidrs=true

- --configure-cloud-routes=true

- --cluster-cidr=172.17.0.0/16

tolerations:

# this is required so CCM can bootstrap itself

- key: node.cloudprovider.kubernetes.io/uninitialized

value: "true"

effect: NoSchedule

# this is to have the daemonset runnable on master nodes

# the taint may vary depending on your cluster setup

- key: node-role.kubernetes.io/master

effect: NoSchedule

# this is to restrict CCM to only run on master nodes

# the node selector may vary depending on your cluster setup

nodeSelector:

node-role.kubernetes.io/master: ""

限制

运行云管理控制器会有一些可能的限制。虽然以后的版本将处理这些限制,但是知道这些生产负载的限制很重要。

对 Volume 的支持

云管理控制器未实现 kube-controller-manager 中的任何 volume 控制器,因为和 volume 的集成还需要与 kubelet 协作。由于我们引入了 CSI (容器存储接口,container storage interface) 并对弹性 volume 插件添加了更强大的支持,云管理控制器将添加必要的支持,以使云服务同 volume 更好的集成。请在 这里 了解更多关于 out-of-tree CSI volume 插件的信息。

可扩展性

在以前为云服务提供商提供的架构中,我们依赖 kubelet 的本地元数据服务来获取关于它本身的节点信息。通过这个新的架构,现在我们完全依赖云管理控制器来获取所有节点的信息。对于非常大的集群,你需要考虑可能的瓶颈,例如资源需求和 API 速率限制。

鸡和蛋的问题

云管理控制器的目标是将云服务特性的开发从 Kubernetes 核心项目中解耦。 不幸的是,Kubernetes 项目的许多方面都假设云服务提供商的特性同项目紧密结合。 因此,这种新架构的采用可能导致某些场景下,当一个请求需要从云服务提供商获取信息时, 在该请求没有完成的情况下云管理控制器不能返回那些信息。

Kubelet 中的 TLS 引导特性是一个很好的例子。 目前,TLS 引导认为 kubelet 有能力从云提供商(或本地元数据服务)获取所有的地址类型(私有、公用等), 但在被初始化之前,云管理控制器不能设置节点地址类型,而这需要 kubelet 拥有 TLS 证书以和 API 服务器通信。

随着整个动议的演进,将来的发行版中将作出改变来解决这些问题。

接下来

要构建和开发你自己的云管理控制器,请阅读 开发云管理控制器 文档。

8 - 为 Kubernetes 运行 etcd 集群

etcd 是兼具一致性和高可用性的键值数据库,可以作为保存 Kubernetes 所有集群数据的后台数据库。

您的 Kubernetes 集群的 etcd 数据库通常需要有个备份计划。

要了解 etcd 更深层次的信息,请参考 etcd 文档。

准备开始

你必须拥有一个 Kubernetes 的集群,同时你的 Kubernetes 集群必须带有 kubectl 命令行工具。 如果你还没有集群,你可以通过 Minikube 构建一 个你自己的集群,或者你可以使用下面任意一个 Kubernetes 工具构建:

要获知版本信息,请输入kubectl version.先决条件

运行的 etcd 集群个数成员为奇数。

etcd 是一个 leader-based 分布式系统。确保主节点定期向所有从节点发送心跳,以保持集群稳定。

确保不发生资源不足。

集群的性能和稳定性对网络和磁盘 I/O 非常敏感。任何资源匮乏都会导致心跳超时, 从而导致集群的不稳定。不稳定的情况表明没有选出任何主节点。 在这种情况下,集群不能对其当前状态进行任何更改,这意味着不能调度新的 pod。

保持 etcd 集群的稳定对 Kubernetes 集群的稳定性至关重要。 因此,请在专用机器或隔离环境上运行 etcd 集群,以满足 所需资源需求。

在生产中运行的 etcd 的最低推荐版本是

3.2.10+。

资源要求

使用有限的资源运行 etcd 只适合测试目的。为了在生产中部署,需要先进的硬件配置。 在生产中部署 etcd 之前,请查看 所需资源参考文档。

启动 etcd 集群

本节介绍如何启动单节点和多节点 etcd 集群。

单节点 etcd 集群

只为测试目的使用单节点 etcd 集群。

运行以下命令:

etcd --listen-client-urls=http://$PRIVATE_IP:2379 \ --advertise-client-urls=http://$PRIVATE_IP:2379使用参数

--etcd-servers=$PRIVATE_IP:2379启动 Kubernetes API 服务器。确保将

PRIVATE_IP设置为etcd客户端 IP。

多节点 etcd 集群

为了耐用性和高可用性,在生产中将以多节点集群的方式运行 etcd,并且定期备份。 建议在生产中使用五个成员的集群。 有关该内容的更多信息,请参阅 常见问题文档。

可以通过静态成员信息或动态发现的方式配置 etcd 集群。 有关集群的详细信息,请参阅 etcd 集群文档。

例如,考虑运行以下客户端 URL 的五个成员的 etcd 集群:http://$IP1:2379,

http://$IP2:2379,http://$IP3:2379,http://$IP4:2379 和 http://$IP5:2379。

要启动 Kubernetes API 服务器:

运行以下命令:

etcd --listen-client-urls=http://$IP1:2379,http://$IP2:2379,http://$IP3:2379,http://$IP4:2379,http://$IP5:2379 --advertise-client-urls=http://$IP1:2379,http://$IP2:2379,http://$IP3:2379,http://$IP4:2379,http://$IP5:2379使用参数

--etcd-servers=$IP1:2379,$IP2:2379,$IP3:2379,$IP4:2379,$IP5:2379启动 Kubernetes API 服务器。确保将

IP<n>变量设置为客户端 IP 地址。

使用负载均衡的多节点 etcd 集群

要运行负载均衡的 etcd 集群:

- 建立一个 etcd 集群。

- 在 etcd 集群前面配置负载均衡器。例如,让负载均衡器的地址为

$LB。 - 使用参数

--etcd-servers=$LB:2379启动 Kubernetes API 服务器。

安全的 etcd 集群

对 etcd 的访问相当于集群中的 root 权限,因此理想情况下只有 API 服务器才能访问它。 考虑到数据的敏感性,建议只向需要访问 etcd 集群的节点授予权限。

想要确保 etcd 的安全,可以设置防火墙规则或使用 etcd 提供的安全特性,这些安全特性依赖于 x509 公钥基础设施(PKI)。

首先,通过生成密钥和证书对来建立安全的通信通道。

例如,使用密钥对 peer.key 和 peer.cert 来保护 etcd 成员之间的通信,

而 client.key 和 client.cert 用于保护 etcd 与其客户端之间的通信。

请参阅 etcd 项目提供的示例脚本,

以生成用于客户端身份验证的密钥对和 CA 文件。

安全通信

若要使用安全对等通信对 etcd 进行配置,请指定参数 --peer-key-file=peer.key

和 --peer-cert-file=peer.cert,并使用 HTTPS 作为 URL 模式。

类似地,要使用安全客户端通信对 etcd 进行配置,请指定参数 --key-file=k8sclient.key

和 --cert-file=k8sclient.cert,并使用 HTTPS 作为 URL 模式。

使用安全通信的客户端命令的示例:

ETCDCTL_API=3 etcdctl --endpoints 10.2.0.9:2379 \

--cert=/etc/kubernetes/pki/etcd/server.crt \

--key=/etc/kubernetes/pki/etcd/server.key \

--cacert=/etc/kubernetes/pki/etcd/ca.crt \

member list

限制 etcd 集群的访问

配置安全通信后,将 etcd 集群的访问限制在 Kubernetes API 服务器上。使用 TLS 身份验证来完成此任务。

例如,考虑由 CA etcd.ca 信任的密钥对 k8sclient.key 和 k8sclient.cert。

当 etcd 配置为 --client-cert-auth 和 TLS 时,它使用系统 CA 或由 --trusted-ca-file 参数传入的 CA 验证来自客户端的证书。

指定参数 --client-cert-auth=true 和 --trusted-ca-file=etcd.ca 将限制对具有证书 k8sclient.cert 的客户端的访问。

一旦正确配置了 etcd,只有具有有效证书的客户端才能访问它。要让 Kubernetes API 服务器访问,

可以使用参数 --etcd-certfile=k8sclient.cert,--etcd-keyfile=k8sclient.key 和 --etcd-cafile=ca.cert 配置。

说明: Kubernetes 目前不支持 etcd 身份验证。 想要了解更多信息,请参阅相关的问题 支持 etcd v2 的基本认证。

替换失败的 etcd 成员

etcd 集群通过容忍少数成员故障实现高可用性。 但是,要改善集群的整体健康状况,请立即替换失败的成员。当多个成员失败时,逐个替换它们。 替换失败成员需要两个步骤:删除失败成员和添加新成员。

虽然 etcd 在内部保留唯一的成员 ID,但建议为每个成员使用唯一的名称,以避免人为错误。

例如,考虑一个三成员的 etcd 集群。让 URL 为:member1=http://10.0.0.1, member2=http://10.0.0.2

和 member3=http://10.0.0.3。当 member1 失败时,将其替换为 member4=http://10.0.0.4。

获取失败的

member1的成员 ID:etcdctl --endpoints=http://10.0.0.2,http://10.0.0.3 member list显示以下信息:

8211f1d0f64f3269, started, member1, http://10.0.0.1:2380, http://10.0.0.1:2379 91bc3c398fb3c146, started, member2, http://10.0.0.2:2380, http://10.0.0.2:2379 fd422379fda50e48, started, member3, http://10.0.0.3:2380, http://10.0.0.3:2379移除失败的成员

etcdctl member remove 8211f1d0f64f3269显示以下信息:

Removed member 8211f1d0f64f3269 from cluster增加新成员:

etcdctl member add member4 --peer-urls=http://10.0.0.4:2380显示以下信息:

Member 2be1eb8f84b7f63e added to cluster ef37ad9dc622a7c4在 IP 为

10.0.0.4的机器上启动新增加的成员:export ETCD_NAME="member4" export ETCD_INITIAL_CLUSTER="member2=http://10.0.0.2:2380,member3=http://10.0.0.3:2380,member4=http://10.0.0.4:2380" export ETCD_INITIAL_CLUSTER_STATE=existing etcd [flags]做以下事情之一:

- 更新 Kubernetes API 服务器的

--etcd-servers参数,使 Kubernetes 知道配置进行了更改,然后重新启动 Kubernetes API 服务器。 - 如果在 deployment 中使用了负载均衡,更新负载均衡配置。

- 更新 Kubernetes API 服务器的

有关集群重新配置的详细信息,请参阅 etcd 重构文档。

备份 etcd 集群

所有 Kubernetes 对象都存储在 etcd 上。定期备份 etcd 集群数据对于在灾难场景(例如丢失所有控制平面节点)下恢复 Kubernetes 集群非常重要。 快照文件包含所有 Kubernetes 状态和关键信息。为了保证敏感的 Kubernetes 数据的安全,可以对快照文件进行加密。

备份 etcd 集群可以通过两种方式完成:etcd 内置快照和卷快照。

内置快照

etcd 支持内置快照。快照可以从使用 etcdctl snapshot save 命令的活动成员中获取,

也可以通过从 etcd 数据目录

复制 member/snap/db 文件,该 etcd 数据目录目前没有被 etcd 进程使用。获取快照不会影响成员的性能。

下面是一个示例,用于获取 $ENDPOINT 所提供的键空间的快照到文件 snapshotdb:

ETCDCTL_API=3 etcdctl --endpoints $ENDPOINT snapshot save snapshotdb

验证快照:

ETCDCTL_API=3 etcdctl --write-out=table snapshot status snapshotdb

+----------+----------+------------+------------+

| HASH | REVISION | TOTAL KEYS | TOTAL SIZE |

+----------+----------+------------+------------+

| fe01cf57 | 10 | 7 | 2.1 MB |

+----------+----------+------------+------------+

卷快照

如果 etcd 运行在支持备份的存储卷(如 Amazon Elastic Block 存储)上,则可以通过获取存储卷的快照来备份 etcd 数据。

使用 etcdctl 选项的快照

我们还可以使用 etcdctl 提供的各种选项来拍摄快照。例如:

ETCDCTL_API=3 etcdctl -h

列出 etcdctl 可用的各种选项。例如,你可以通过指定端点,证书等来拍摄快照,如下所示:

ETCDCTL_API=3 etcdctl --endpoints=https://127.0.0.1:2379 \

--cacert=<trusted-ca-file> --cert=<cert-file> --key=<key-file> \

snapshot save <backup-file-location>

可以从 etcd Pod 的描述中获得 trusted-ca-file, cert-file 和 key-file 。

扩展 etcd 集群

通过交换性能,扩展 etcd 集群可以提高可用性。缩放不会提高集群性能和能力。 一般情况下不要扩大或缩小 etcd 集群的集合。不要为 etcd 集群配置任何自动缩放组。 强烈建议始终在任何官方支持的规模上运行生产 Kubernetes 集群时使用静态的五成员 etcd 集群。

合理的扩展是在需要更高可靠性的情况下,将三成员集群升级为五成员集群。 请参阅 etcd 重新配置文档 以了解如何将成员添加到现有集群中的信息。

恢复 etcd 集群

etcd 支持从 major.minor 或其他不同 patch 版本的 etcd 进程中获取的快照进行恢复。 还原操作用于恢复失败的集群的数据。

在启动还原操作之前,必须有一个快照文件。它可以是来自以前备份操作的快照文件, 也可以是来自剩余数据目录的快照文件。 例如:

ETCDCTL_API=3 etcdctl --endpoints 10.2.0.9:2379 snapshot restore snapshotdb

有关从快照文件还原集群的详细信息和示例,请参阅 etcd 灾难恢复文档。

如果还原的集群的访问 URL 与前一个集群不同,则必须相应地重新配置 Kubernetes API 服务器。

在本例中,使用参数 --etcd-servers=$NEW_ETCD_CLUSTER 而不是参数 --etcd-servers=$OLD_ETCD_CLUSTER 重新启动 Kubernetes API 服务器。

用相应的 IP 地址替换 $NEW_ETCD_CLUSTER 和 $OLD_ETCD_CLUSTER。如果在 etcd 集群前面使用负载平衡,则可能需要更新负载均衡器。

如果大多数 etcd 成员永久失败,则认为 etcd 集群失败。在这种情况下,Kubernetes 不能对其当前状态进行任何更改。 虽然已调度的 pod 可能继续运行,但新的 pod 无法调度。在这种情况下,恢复 etcd 集群并可能需要重新配置 Kubernetes API 服务器以修复问题。

说明:如果集群中正在运行任何 API 服务器,则不应尝试还原 etcd 的实例。相反,请按照以下步骤还原 etcd:

- 停止 所有 API 服务实例

- 在所有 etcd 实例中恢复状态

- 重启所有 API 服务实例

我们还建议重启所有组件(例如

kube-scheduler、kube-controller-manager、kubelet),以确保它们不会 依赖一些过时的数据。请注意,实际中还原会花费一些时间。 在还原过程中,关键组件将丢失领导锁并自行重启。说明:

9 - 为系统守护进程预留计算资源

Kubernetes 的节点可以按照 Capacity 调度。默认情况下 pod 能够使用节点全部可用容量。

这是个问题,因为节点自己通常运行了不少驱动 OS 和 Kubernetes 的系统守护进程。

除非为这些系统守护进程留出资源,否则它们将与 pod 争夺资源并导致节点资源短缺问题。

kubelet 公开了一个名为 Node Allocatable 的特性,有助于为系统守护进程预留计算资源。

Kubernetes 推荐集群管理员按照每个节点上的工作负载密度配置 Node Allocatable。

准备开始

你必须拥有一个 Kubernetes 的集群,同时你的 Kubernetes 集群必须带有 kubectl 命令行工具。 如果你还没有集群,你可以通过 Minikube 构建一 个你自己的集群,或者你可以使用下面任意一个 Kubernetes 工具构建:

您的 Kubernetes 服务器版本必须不低于版本 1.8. 要获知版本信息,请输入kubectl version.您的 kubernetes 服务器版本必须至少是 1.17 版本,才能使用 kubelet

命令行选项 --reserved-cpus 设置

显式预留 CPU 列表。

节点可分配

Kubernetes 节点上的 Allocatable 被定义为 pod 可用计算资源量。

调度器不会超额申请 Allocatable。

目前支持 CPU, memory 和 ephemeral-storage 这几个参数。

可分配的节点暴露为 API 中 v1.Node 对象的一部分,也是 CLI 中

kubectl describe node 的一部分。

在 kubelet 中,可以为两类系统守护进程预留资源。

启用 QoS 和 Pod 级别的 cgroups

为了恰当的在节点范围实施节点可分配约束,你必须通过 --cgroups-per-qos

标志启用新的 cgroup 层次结构。这个标志是默认启用的。

启用后,kubelet 将在其管理的 cgroup 层次结构中创建所有终端用户的 Pod。

配置 cgroup 驱动

kubelet 支持在主机上使用 cgroup 驱动操作 cgroup 层次结构。

驱动通过 --cgroup-driver 标志配置。

支持的参数值如下:

cgroupfs是默认的驱动,在主机上直接操作 cgroup 文件系统以对 cgroup 沙箱进行管理。systemd是可选的驱动,使用 init 系统支持的资源的瞬时切片管理 cgroup 沙箱。

取决于相关容器运行时的配置,操作员可能需要选择一个特定的 cgroup 驱动

来保证系统正常运行。

例如,如果操作员使用 docker 运行时提供的 systemd cgroup 驱动时,

必须配置 kubelet 使用 systemd cgroup 驱动。

Kube 预留值

- Kubelet 标志:

--kube-reserved=[cpu=100m][,][memory=100Mi][,][ephemeral-storage=1Gi][,][pid=1000] - Kubelet 标志:

--kube-reserved-cgroup=

kube-reserved 用来给诸如 kubelet、容器运行时、节点问题监测器等

kubernetes 系统守护进程记述其资源预留值。

该配置并非用来给以 Pod 形式运行的系统守护进程保留资源。kube-reserved

通常是节点上 pod 密度 的函数。

除了 cpu,内存 和 ephemeral-storage 之外,pid 可用来指定为

kubernetes 系统守护进程预留指定数量的进程 ID。

要选择性地对 kubernetes 系统守护进程上执行 kube-reserved 保护,需要把 kubelet 的

--kube-reserved-cgroup 标志的值设置为 kube 守护进程的父控制组。

推荐将 kubernetes 系统守护进程放置于顶级控制组之下(例如 systemd 机器上的